Jak zainstalować i używać Ollama do uruchamiania dużych modeli językowych (LLM) na komputerze z systemem Windows 11

Istnieje wiele sposobów na uruchomienie dużych modeli językowych (LLM) lokalnie na komputerze z systemem Windows, a Ollama jest jednym z najprostszych i najwydajniejszych.

Najczęstszą interakcją, jaką większość z nas ma obecnie ze sztuczną inteligencją, są narzędzia oparte na chmurze, takie jak ChatGPT أو Drugi pilotNarzędzia te wymagają połączenia z Internetem, ale ich zaletą jest to, że można z nich korzystać niemal na każdym urządzeniu.

Jednak nie każdy chce polegać na chmurze w przypadku aplikacji AI, zwłaszcza programiści. Dlatego chcesz, aby Twój model dużego języka (LLM) działał lokalnie na Twoim urządzeniu. Tu właśnie pojawia się Ollama.

Ollama to narzędzie do wnioskowania, które umożliwia natywne uruchamianie szerokiej gamy dużych modeli językowych (LLM) na komputerze. Nie jest to jedyny sposób, ale jeden z najprostszych i najbardziej przejrzystych. Ollama pozwala wykorzystać potencjał sztucznej inteligencji bez konieczności stałego połączenia z internetem, dając pełną kontrolę nad danymi i prywatnością.

Po uruchomieniu Ollama i wykorzystywanych przez nią dużych modeli językowych (LLM) oferują wiele możliwości, ale pierwszym krokiem jest konfiguracja. Przeprowadzimy Cię przez ten proces krok po kroku, abyś mógł w pełni wykorzystać możliwości tego potężnego narzędzia.

Wymagania systemowe Ollama

Samo uruchomienie Ollama nie zużywa dużo zasobów systemowych i działa na szerokiej gamie urządzeń. Jest kompatybilne z systemami Windows 11, macOS i Linux. Można go nawet używać z dystrybucji Linuksa w systemie Windows 11 za pośrednictwem WSL.

Jednak do uruchomienia samych dużych modeli językowych (LLM) potrzebny jest mocniejszy sprzęt. Im większy model, tym większej mocy obliczeniowej potrzeba. Modele te wymagają do działania procesora graficznego (GPU). Obecnie nie są one zoptymalizowane pod kątem jednostki przetwarzania neuronowego (NPU) w nowych komputerach Copilot+.

Na szczęście istnieją mniejsze modele, których można używać na skromnym sprzęcie. Na przykład model Gemma 3 firmy Google ma model z miliardem parametrów, który wymaga zaledwie 2.3 GB pamięci VRAM do uruchomienia pełnej wersji. Liczba ta wzrasta do ponad 9 GB pamięci VRAM, jeśli przejdziemy na model z 4 miliardami parametrów.

Podobnie jest w przypadku Llama 3.2 firmy Meta, gdzie model z 1 miliardem parametrów wymaga do prawidłowego działania procesora graficznego z zaledwie 4 GB pamięci VRAM. W przypadku modelu z 3 miliardami parametrów ta ilość wzrasta do 8 GB.

Krótko mówiąc, jeśli masz stosunkowo nowoczesny komputer z co najmniej 8 GB pamięci RAM i dedykowanym procesorem graficznym, powinieneś być w stanie odnieść pewne korzyści korzystając z Ollama.

Przewodnik instalacji Ollama w systemie Windows 11

Instalacja Ollama w systemie Windows 11 to bardzo prosty proces, który można podsumować pobierając Zainstaluj program z oficjalnej strony internetowej Lub z Repozytorium GitHub, a następnie zainstaluj ją na swoim urządzeniu.

Oto proste kroki.

Po instalacji i uruchomieniu nic nie pojawi się na pulpicie. Program działa całkowicie w tle, ale jego ikona jest widoczna na pasku zadań.

Aby sprawdzić czy program działa prawidłowo możesz przejść pod adres localhost: 11434 w Twojej przeglądarce internetowej.

Zainstaluj i uruchom swój pierwszy duży model językowy (LLM) w Ollama

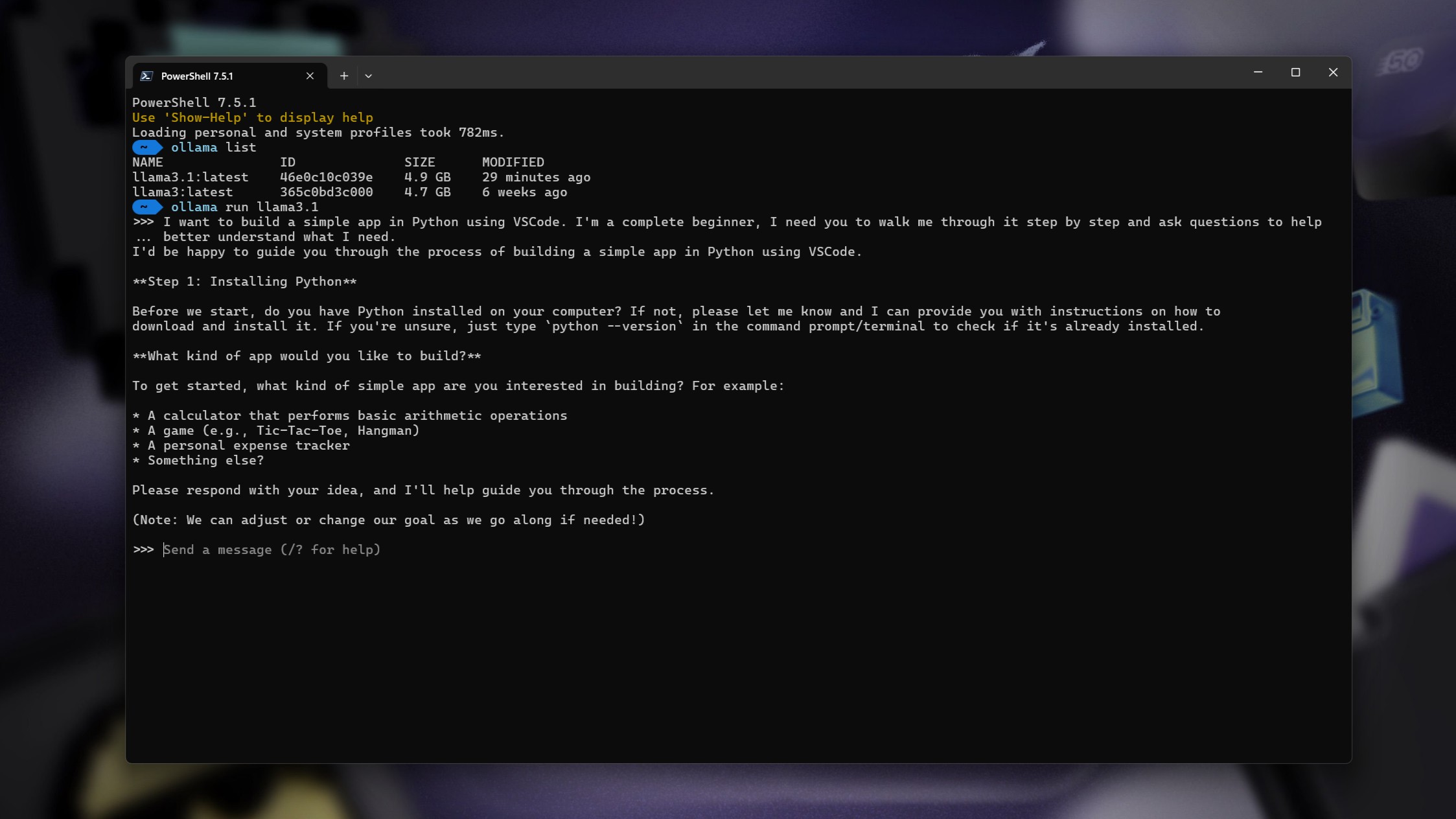

Aby uruchomić swój pierwszy duży model językowy (LLM) za pomocą Ollama, będziesz potrzebować przede wszystkim interfejsu wiersza poleceń (CLI). Otwórz program PowerShell w systemie Windows lub użyj WSL, jeśli masz tam zainstalowaną Ollamę.

Chociaż Ollama posiada graficzne interfejsy użytkownika (GUI), tutaj skupiamy się na korzystaniu z wiersza poleceń. Przyda się, jeśli czujesz się pewnie korzystając z CLI.

Dwie najważniejsze rzeczy, które musisz wiedzieć to:

bieg ollama

ollama położył

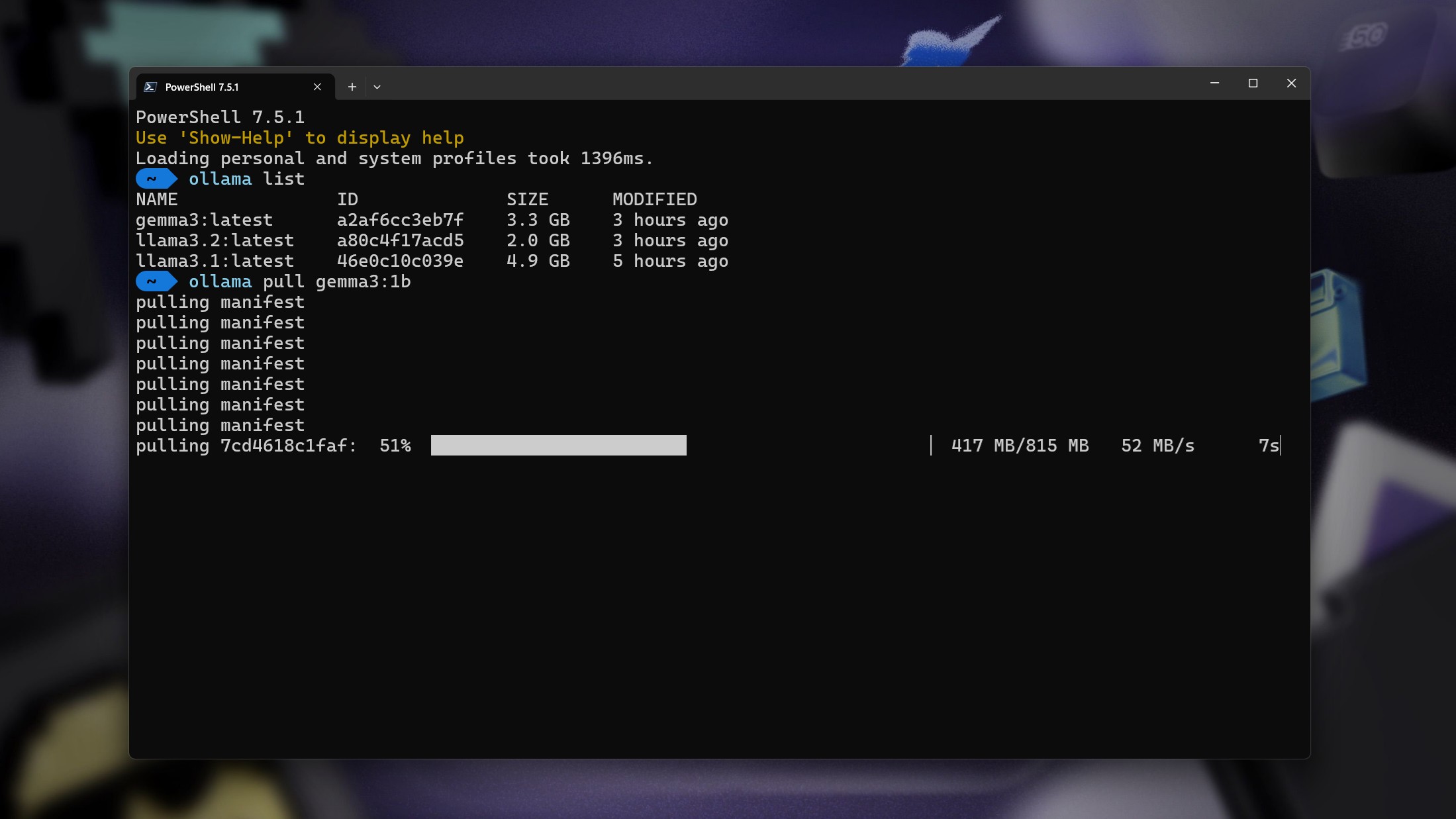

Jeśli poprosisz Ollamę o uruchomienie modelu LLM, który nie jest obecnie zainstalowany, zostanie on automatycznie pobrany i uruchomiony. Poprawne nazwy dużych modeli językowych, które chcesz zainstalować, znajdziesz na stronie Strona internetowa Ollama.

Na przykład, aby zainstalować i uruchomić model Google Gemma 3 LLM składający się z miliarda parametrów, wprowadź następujące polecenie:

ollama run Gemma:1b

Należy pamiętać o dodaniu :1b Po nazwie określ, że chcesz model z 1 miliardem parametrów. Jeśli chcesz model z 4 miliardami parametrów, zmień nazwę na **:4b**.

Po uruchomieniu formularzy w terminalu otworzy się znajomy interfejs chatbota, który umożliwi Ci pisanie monitów i odbieranie odpowiedzi — wszystko to będzie działać lokalnie na Twoim urządzeniu.

Aby wyjść z formularza i powrócić do programu PowerShell, wystarczy wpisać **/bye**, a proces zostanie zakończony.

Obejmuje to absolutne podstawy konfiguracji Ollama na komputerze, aby móc korzystać z pakietu LLM. Podstawowa konfiguracja jest bardzo prosta i łatwa, nie wymagając praktycznie żadnej wiedzy technicznej. Skoro ja potrafię, Ty też potrafisz!

Możliwość dodawania komentarzy nie jest dostępna.