Jak zainstalować najnowsze modele językowe (LLM) lokalnie na komputerze Mac

W ostatnich latach modele dużych języków (LLM) zyskały na popularności ze względu na możliwość generowania tekstu zbliżonego do ludzkiego i wspomagania różnych zadań. Nie wszystkie modele są dostępne w modelu open source, ale niemal każda duża firma technologiczna ma wersję, którą użytkownicy mogą pobrać i uruchomić.

Uruchamianie tych modeli lokalnie na komputerze Mac może być korzystne zarówno ze względu na prywatność, jak i koszty. W tym artykule dowiesz się, jak zainstalować i uruchomić modele LLM za pomocą… OllamaJest to potężne narzędzie dla deweloperów i początkujących użytkowników. Omówimy w nim niektóre narzędzia graficznego interfejsu użytkownika, które mogą uprościć proces dla tych, którzy nie chcą korzystać z terminala macOS.

W ten sposób możesz uzyskać dostęp do najnowszych szablonów tekstowych opartych na sztucznej inteligencji od firm [Google], [Microsoft], [Meta] i innych firm zajmujących się sztuczną inteligencją, takich jak [Mistral] i [DeepSeek].

Zrozumienie LLM: Co oznaczają parametry?

Zanim przejdziemy do procesu instalacji, wyjaśnijmy, co oznaczają liczby takie jak „7B"Lub"14BW odniesieniu do LLM liczby te oznaczają rozmiar modelu w kategoriach nauczyciele (W miliardach), które są w zasadzie „uchwytami i przełącznikami”, precyzyjnie regulowanymi podczas treningu.

Większa liczba parametrów pozwala modelowi uchwycić bardziej złożone wzorce i relacje w języku, co potencjalnie prowadzi do lepszej wydajności. Należy jednak pamiętać, że większa liczba parametrów nie zawsze gwarantuje lepsze wyniki; jakość danych treningowych i zasoby obliczeniowe dostępne dla modelu również odgrywają istotną rolę.

Wymagania systemowe

Musisz się upewnić, że Twój [Mac] spełnia co najmniej następujące wymagania:

- macOS 10.15 lub nowszy (zalecany jest macOS 13 lub nowszy)

- Co najmniej 8 GB pamięci RAM (zalecane 16 GB lub więcej)

- 10 GB wolnej przestrzeni dyskowej (minimalne wymagania dla najmniejszych modeli; bardziej zaawansowane modele z maksymalną liczbą parametrów wymagają około 700 GB)

- Procesor wielordzeniowy [Intel] lub procesor [Apple Silicon] (preferowany M2 lub wyższy)

Zainstaluj Ollamę

Ollama To narzędzie typu open source, które pozwala uruchamiać programy LLM bezpośrednio na komputerze lokalnym. Oto jak zacząć:

- Pobierz OllamęOdwiedź stronę internetową: Ollama Pobierz wersję na macOS. Możesz też użyć [Homebrew], aby ją zainstalować, uruchamiając

brew install ollamaW Twoim terminalu.

- Zainstaluj OllamęJeśli pobrałeś instalator, kliknij go dwukrotnie i postępuj zgodnie z instrukcjami kreatora instalacji. Jeśli używasz Homebrew, przejdź do kroku 4.

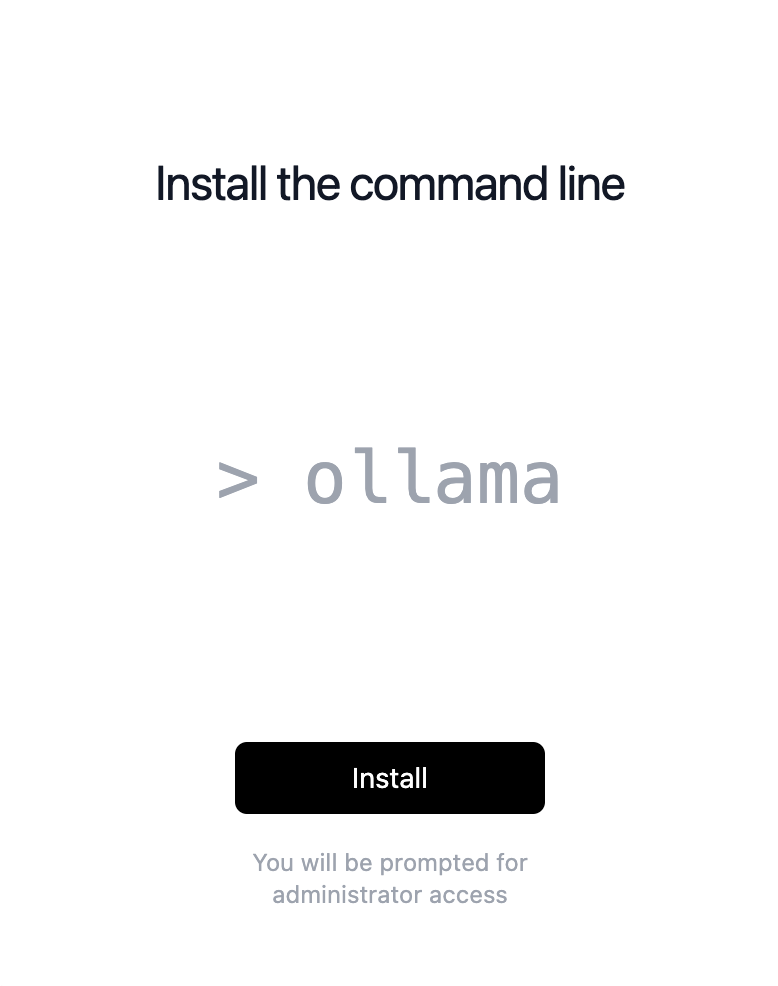

- Następnym krokiem instalatora jest po prostu kliknięcie przycisku. تثبيتZostaniesz poproszony o podanie hasła administratora.

- Operacja OllamaOtwórz okno terminala i uruchom Ollamę jako usługę, używając polecenia

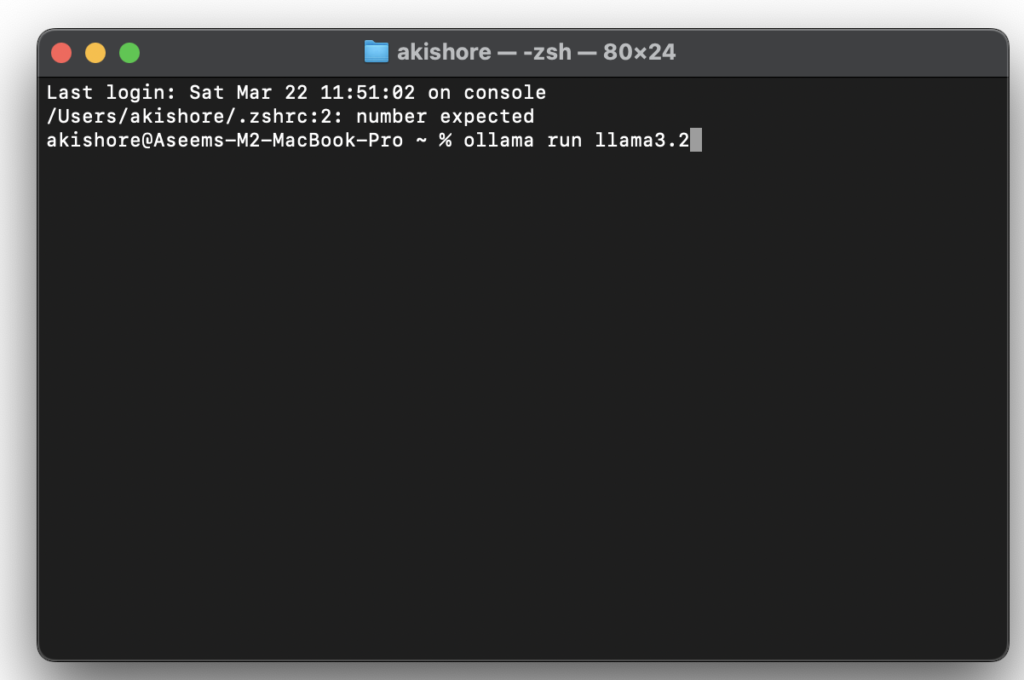

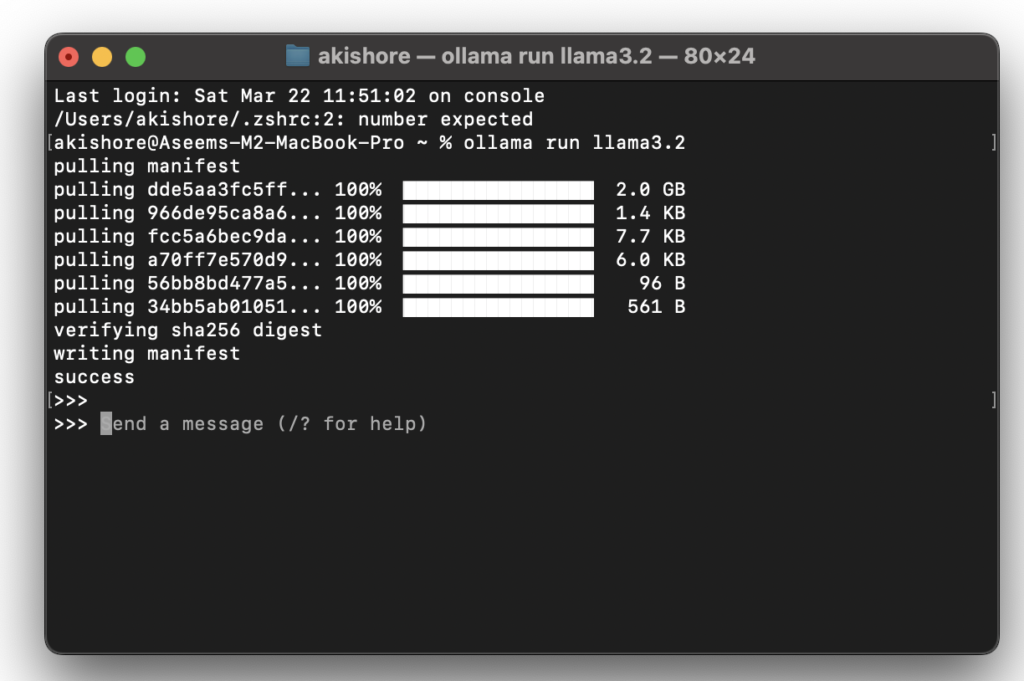

brew services start ollamaDzięki temu Ollama będzie dostępna pod tym adresemhttp://localhost:11434/. - Pobierz i uruchom modelUżyj polecenia

ollama pull <model-name>Aby pobrać szablon, należy użyć poleceniaollama run <model-name>Aby go uruchomić. Na przykład, aby uruchomić model DeepSeek-R1Użyj poleceniaollama pull deepseek-r1Następuje zamówienieollama run deepseek-r1. - Aby pobrać większą wersję szablonu, wystarczy dodać dwie pionowe kropki, a następnie rozmiar. Na przykład, aby pobrać szablon 14B Głębokie poszukiwanieUżyjesz polecenia ollama uruchom deepseek-r1:14bNa stronie Ollama możesz kliknąć dowolny formularz, aby wyświetlić wszystkie polecenia dla każdej wersji.

Pełną listę znajdziesz Modele Ollama Tutaj. Możesz również użyć drugiego polecenia, jak opisano powyżej, i jeśli nie jest ono jeszcze zainstalowane, najpierw pobierze formularz, a następnie go uruchomi.

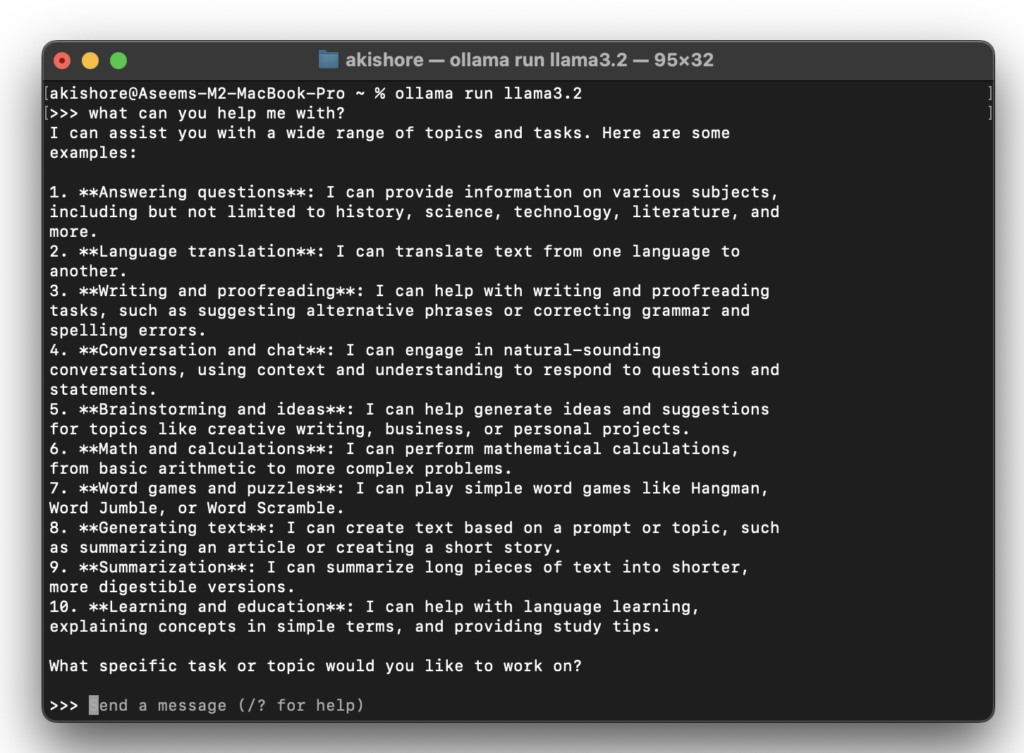

Teraz, gdy widzisz trzy strzałki skierowane w prawo (>>>), możesz zacząć wpisywać polecenia w formularzu.

To wszystko! Możesz teraz komunikować się lokalnie ze swoim absolwentem AI LLM bez obaw o koszty, nadużywanie czy możliwość czytania tego, co piszesz. To świetne rozwiązanie, jeśli masz jakieś drażliwe lub osobiste tematy, które chciałbyś omówić z absolwentem AI LLM, ale nie chcesz, żeby duża firma technologiczna czytała Twoje myśli.

Korzystanie z narzędzi graficznego interfejsu użytkownika w Ollama

Chociaż Ollama jest potężnym i wydajnym narzędziem dla programistów, niektórzy użytkownicy mogą preferować graficzny interfejs użytkownika (GUI) do interakcji z LLM-ami. Oto kilka narzędzi, które mogą zapewnić interfejs graficzny dla Ollama:

-

-

- Interfejs graficzny OllamaTo darmowa i otwarta aplikacja dla użytkowników systemu macOS, stworzona w oparciu o SwiftUI. Oferuje ona elegancki interfejs i stanowi doskonałą opcję dla osób, które chcą uzyskać dostęp do formularzy LLM lokalnie, bez użycia terminala.

- Interfejs użytkownika OllamaProsty, oparty na HTML-u internetowy interfejs użytkownika, który pozwala definiować formularze i korzystać z nich bezpośrednio w przeglądarce. Zawiera również rozszerzenie do przeglądarki Chrome, zapewniające łatwy dostęp.

- Czatbox AITo najłatwiejsza opcja dla początkujących i poniżej wyjaśnię, jak z niej korzystać. Pamiętaj, że nie musisz wykupić usługi Chatbox AI, która jest oferowana w ramach subskrypcji, dzięki czemu możesz uzyskać dostęp do wszystkich szablonów LLM bez konieczności samodzielnej instalacji Ollama.

-

Aby skorzystać z najlepszego interfejsu Chatbox AI, przejdź do strona pobierania Pobierz wersję na komputer Mac.

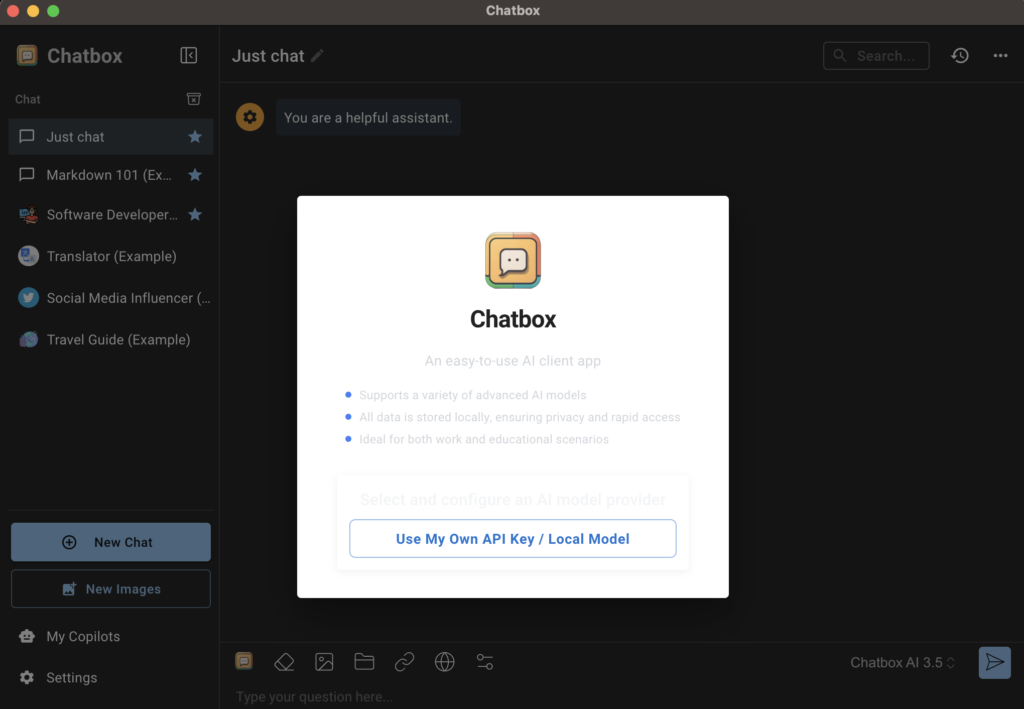

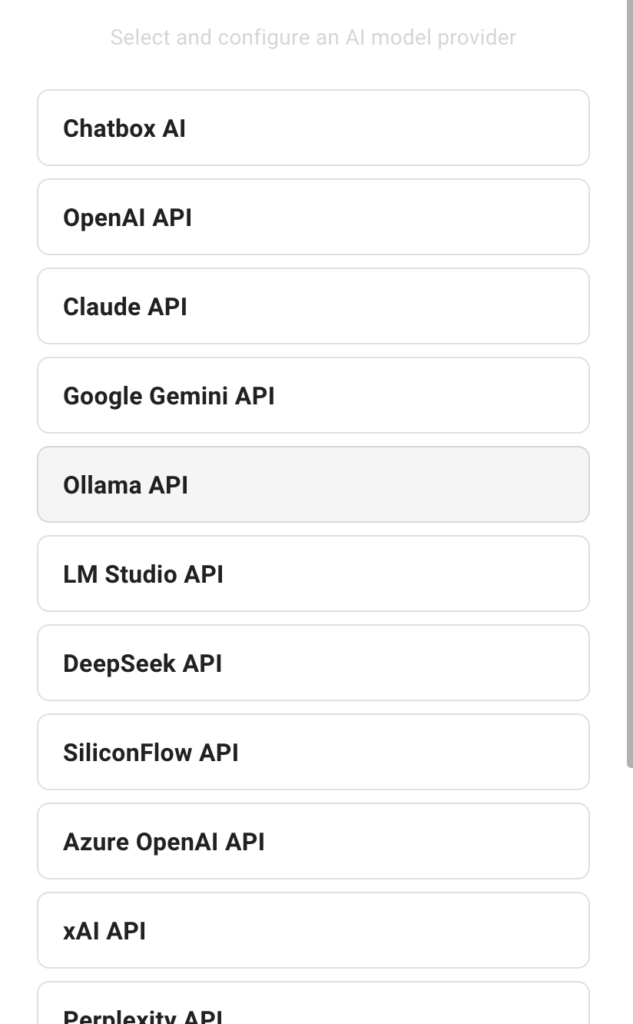

Następnie otwórz instalator i uruchom program. Na pierwszym ekranie pojawi się okno z pytaniem, jak korzystać z Chatbox AI.

Będziesz musiał kliknąć przycisk Użyj własnego klucza API / modelu lokalnego.

Następnie dotknij API Ollama Jako dostawca modeli sztucznej inteligencji.

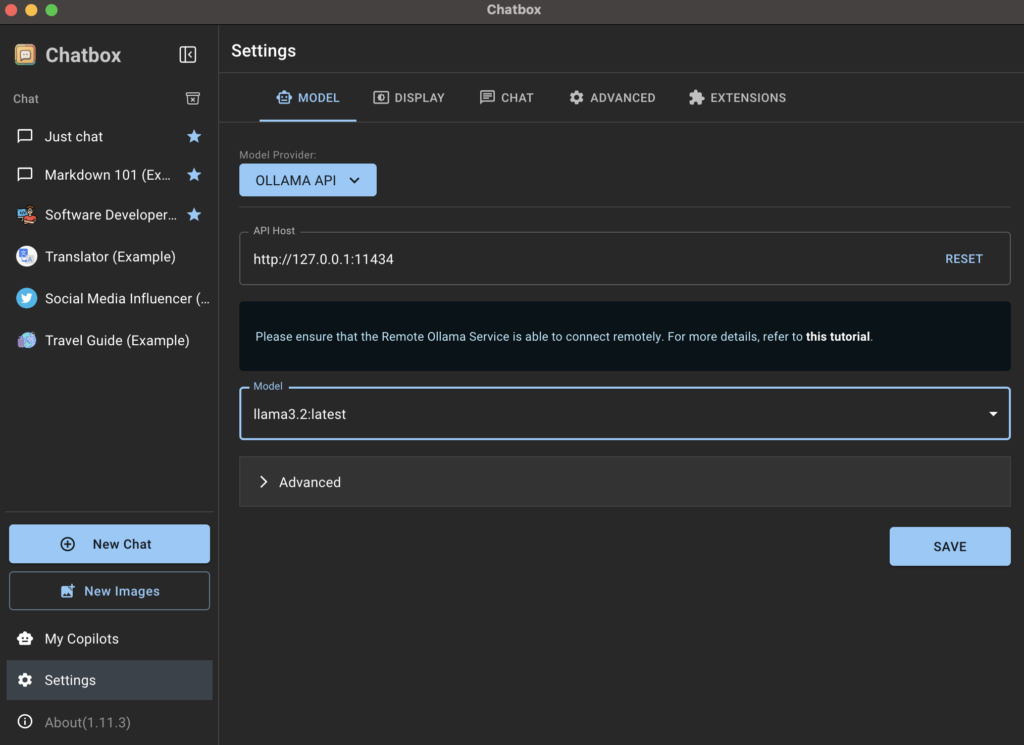

Chatbox AI powinien automatycznie wykryć, że Ollama jest uruchomiona i ustawić host API na wartość domyślną, czyli adres IP pętli zwrotnej numer portu 11434Nie musisz tu niczego zmieniać. W formularzu powinny być widoczne formularze, które zainstalowałeś wcześniej za pomocą terminala. W moim przypadku to formularz lama 3.2.

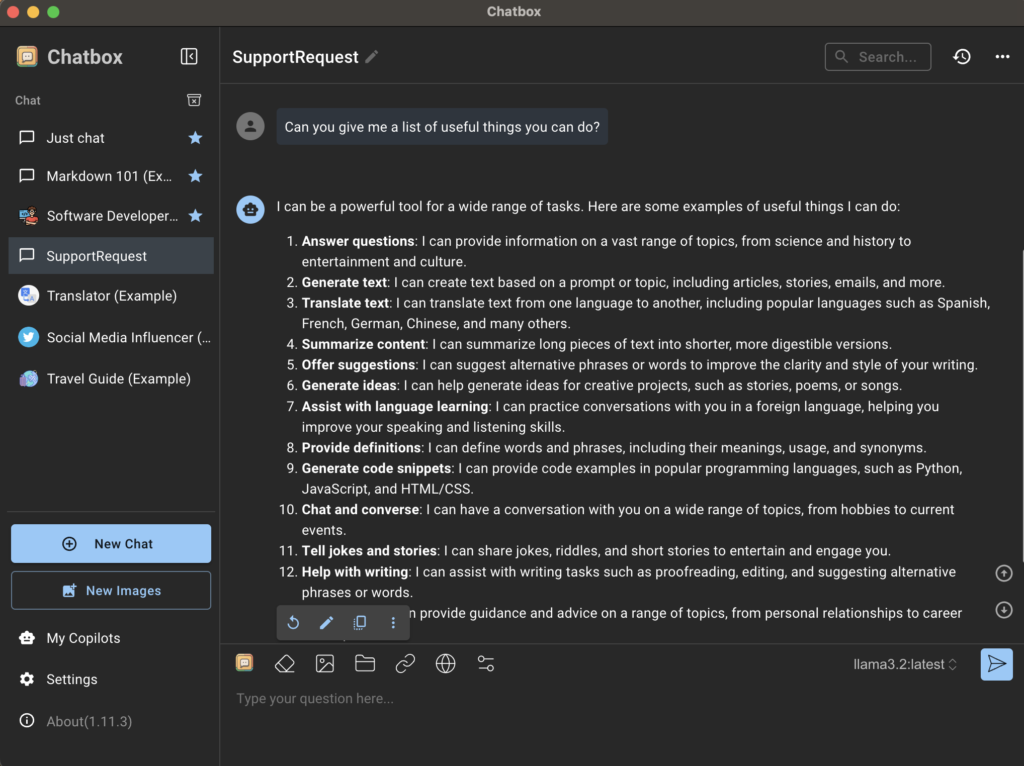

Wracając do strony głównej aplikacji, kliknij Po prostu porozmawiać أو Nowy czat Upewnij się, że wybrałeś właściwy szablon w prawym dolnym rogu. Możesz go zmienić w dowolnym momencie, ale polecam utworzenie nowego czatu dla każdego używanego szablonu, aby łatwo zobaczyć różnice.

Alternatywne narzędzia do lokalnego uruchamiania modeli LLM

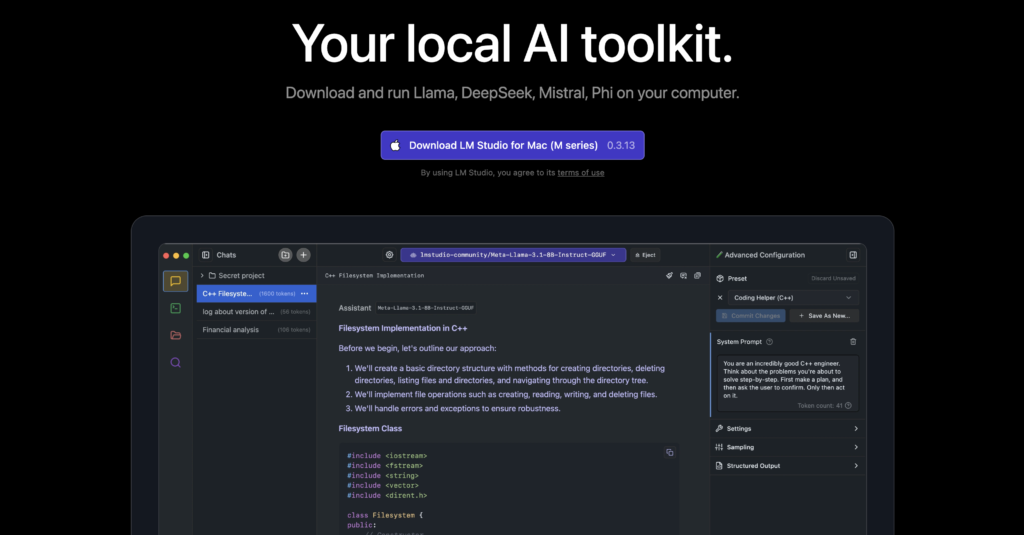

Jeśli szukasz alternatywy dla Ollama lub wolisz bardziej przyjazne użytkownikowi doświadczenie od samego początku, to Studio LM To kolejna doskonała opcja. Oferuje przyjazny dla użytkownika interfejs do eksploracji i korzystania z różnych modeli AI, umożliwiając ich łatwe pobieranie i uruchamianie. LM Studio jest dostępne dla systemów Linux, Mac i Windows i oferuje takie funkcje, jak dostosowywanie parametrów modelu i historii czatów. Obecnie jest darmowe, dlatego polecam je zamiast subskrypcji Chatbox AI.

Wniosek

Uruchamianie dużych modeli językowych (LLM) lokalnie na komputerze Mac będzie ważne dla każdego, kto chce zyskać większą kontrolę nad swoimi aplikacjami AI i priorytetowo traktować prywatność danych. Dzięki narzędziom takim jak Ollama i wspomnianym graficznym interfejsom użytkownika, które ułatwiają integrację LLM z procesem pracy, możesz bezpiecznie uwolnić nowy potencjał produktywności i kreatywności.

Jednak rozpoczęcie lokalnego wdrożenia LLM wymaga pewnego zrozumienia parametrów i ich wpływu na wydajność tych modeli na konkretnym komputerze. Najlepszym sposobem, aby się tego nauczyć, jest eksperymentowanie z różnymi modelami, aby sprawdzić, które z nich dają najlepsze rezultaty. Zrozumienie tej koncepcji pozwoli Ci podejmować lepsze decyzje dotyczące wyboru modeli i optymalizacji ich wydajności, aby dopasować je do Twoich konkretnych potrzeb.

Możliwość dodawania komentarzy nie jest dostępna.