Ryzyko związane ze sztuczną inteligencją w przedsiębiorstwach: alternatywy dla OpenAI i instytucje stojące za agentami AI

Luki w zakresie prywatności danych, zgodności i zaufania w obecnych integracjach agentów AI

„Czekaj… czy wysyłasz wpisy do księgi głównej do OpenAI?”

To było pierwsze, o co zapytała mnie moja przyjaciółka, kiedy jej to pokazałem. Czuj-pisz, aplikacja do prowadzenia dziennika oparta na sztucznej inteligencji, którą stworzyłem podczas hackathonu w San Francisco.

Wzruszyłem ramionami.

„To był hackathon poświęcony sztucznej inteligencji i musiałem szybko coś stworzyć”.

Nie przegapiła ani chwili:

„Jasne. Ale jak mogę zaufać temu, co stworzyłem? Czemu nie zorganizować własnego LLM?”

To mnie zatrzymało.

Byłem dumny z szybkości, z jaką powstała aplikacja. Ale to jedno pytanie i kolejne, które po nim nastąpiły, ujawniły wszystko, co myślałem, że wiem o odpowiedzialnym budowaniu z wykorzystaniem sztucznej inteligencji. Sędziowie hackathonu również to zauważyli.

W tym momencie uświadomiłem sobie, jak bardzo lekceważymy sztuczną inteligencję, zwłaszcza narzędzia, które przetwarzają poufne dane.

Uświadomiłem sobie coś ważniejszego:

Za mało mówimy o zaufaniu budując rozwiązania z wykorzystaniem sztucznej inteligencji.

Jej odpowiedź utkwiła mi w pamięci. Georgia von Minden jest analitykiem danych w ACLU (Amerykańskiej Unii Swobód Obywatelskich), gdzie ściśle zajmuje się kwestiami związanymi z danymi osobowymi w kontekście prawnym i praw obywatelskich. Zawsze ceniłam jej spostrzeżenia, ale ta rozmowa była inna.

Więc poprosiłem ją o wyjaśnienie. Co tak naprawdę oznacza zaufanie w tym kontekście? Zwłaszcza gdy systemy sztucznej inteligencji przetwarzają dane osobowe.

Powiedziała mi:

„Budowanie zaufania może być trudne, ale zarządzanie danymi to dobry punkt wyjścia. Ważne jest, kto jest właścicielem danych, jak są przechowywane i do czego są wykorzystywane. Dziesięć lat temu odpowiedziałbym na to pytanie inaczej. Ale dziś, z ogromną mocą obliczeniową i ogromnymi bazami danych, wnioskowanie na dużą skalę stanowi realny problem. OpenAI ma tak szeroki dostęp zarówno do obliczeń, jak i danych, że jego brak transparentności uzasadnia ostrożność”.

„Jeśli chodzi o dane osobowe (PII), zarówno przepisy, jak i zdrowy rozsądek wskazują na potrzebę silnego zarządzania danymi. Wysyłanie danych osobowych w wywołaniach API jest nie tylko ryzykowne, ale może również naruszać te zasady i narażać użytkowników na niebezpieczeństwo”.

Przypomniało mi to, że gdy budujemy systemy z wykorzystaniem sztucznej inteligencji, zwłaszcza te, które przetwarzają poufne dane ludzkie, nie ograniczamy się do pisania kodu.

Podejmujemy decyzje dotyczące prywatności, autorytetu i zaufania.

W momencie gromadzenia danych użytkowników, zwłaszcza danych osobowych, takich jak wpisy do dziennika, wkraczasz w przestrzeń odpowiedzialności. Nie chodzi tylko o to, co Twój model potrafi. Chodzi o to, co się z tymi danymi dzieje, gdzie trafiają i kto ma do nich dostęp. Odpowiedzialne zarządzanie danymi użytkowników zwiększa zaufanie użytkowników i chroni ich prywatność.

Iluzja prostoty

Dziś wprowadzenie na rynek czegoś, co wygląda na inteligentne, jest łatwiejsze niż kiedykolwiek. Dzięki dużym modelom językowym (LLM), takim jak OpenAI i inne, programiści mogą tworzyć narzędzia AI w ciągu kilku godzin. Startupy mogą wdrażać funkcje „napędzane sztuczną inteligencją” z dnia na dzień. Przedsiębiorstwa? Spieszą się z integracją tych agentów ze swoimi procesami pracy.

Ale w tym całym podnieceniu często pomija się jedną rzecz: Pewność siebie.

Kiedy ludzie mówią o Agenci AICzęsto odnoszą się do prostych wrapperów dla dużych modeli językowych (LLM). Agenci ci mogą odpowiadać na pytania, automatyzować zadania, a nawet podejmować decyzje. Jednak wiele z nich jest tworzonych w pośpiechu, z niewielką dbałością o bezpieczeństwo, zgodność z przepisami i rozliczalność.

Wystarczy użyć produktu OpenAI To nie znaczy, że jest bezpiecznie. Naprawdę ufasz całemu procesowi:

- Kto stworzył okładkę?

- W jaki sposób przetwarzamy Twoje dane?

- Czy Twoje dane są przechowywane, rejestrowane, a co gorsza, wyciekają?

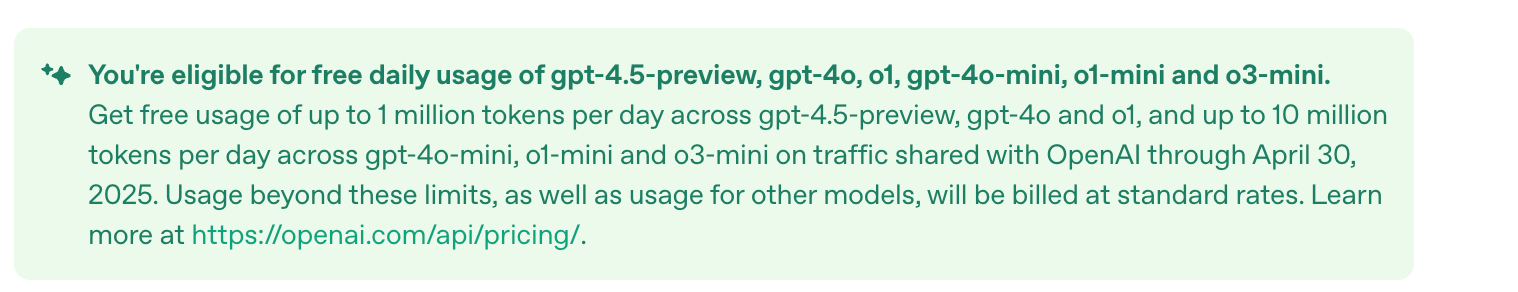

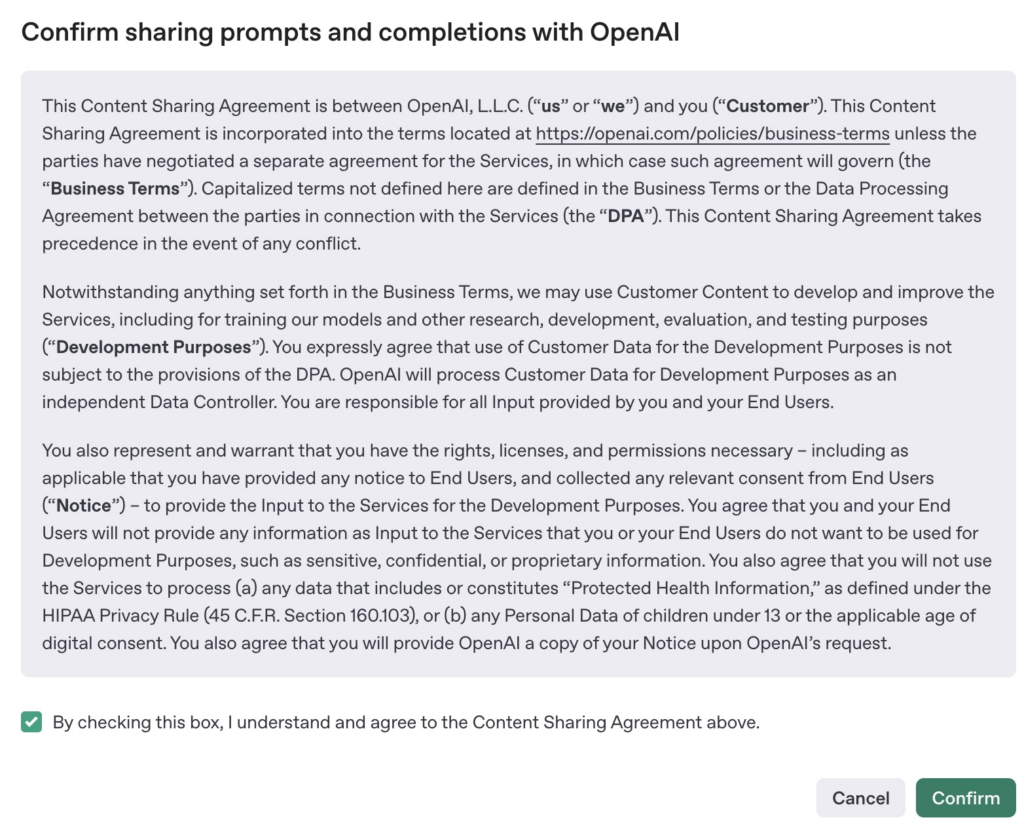

Sam korzystam z API OpenAI w zastosowaniach klientów. Niedawno zaoferowano mi darmowy dostęp do API – do miliona tokenów dziennie do końca kwietnia. Jeżeli wyrażam zgodę na udostępnienie danych dotyczących moich roszczeń.

Prawie się na to zgodziłem w ramach prywatnego projektu pobocznego, ale potem przyszło mi do głowy: gdyby dostawca rozwiązań zgodził się na tę samą ofertę, aby obniżyć koszty, jego użytkownicy nie mieliby pojęcia, że ich dane są udostępniane. Na poziomie osobistym może się to wydawać nieszkodliwe. Ale w kontekście przedsiębiorstwa? To poważne naruszenie prywatności, a potencjalnie także zobowiązań umownych lub regulacyjnych.

Wystarczy, że jeden inżynier zgodzi się na tego typu transakcję, a dane Twoich klientów trafią w czyjeś ręce.

Sztuczna inteligencja przedsiębiorstw podnosi oczekiwania

Obserwuję rosnącą liczbę firm SaaS i startupów oferujących narzędzia programistyczne, eksperymentujących z agentami AI. Niektóre z nich osiągają dobre rezultaty, a niektórzy agenci AI pozwalają użytkownikom na korzystanie z własnych modeli LLM (ang. Large Language Models), dając im kontrolę nad tym, gdzie model działa i jak przetwarzane są dane. To mądre podejście, zwłaszcza że sztuczna inteligencja zyskuje na znaczeniu w przedsiębiorstwach.

Oto przemyślane podejście: Ty ustalasz limity zaufania..

Jednak nie wszyscy są tak chętni.

Wiele firm po prostu łączy się z API OpenAI, dodaje kilka przycisków i nazywa rozwiązanie „gotowym do użytku korporacyjnego”.

Ostrzeżenie: To nieprawda.

Co mogłoby pójść nie tak? Wiele.

Jeśli zintegrujesz agentów AI ze swoją infrastrukturą bez zadania sobie trudnych pytań, możesz narazić się na następujące potencjalne zagrożenia:

- wyciek danychTwoje roszczenia mogą obejmować poufne dane klientów, klucze API lub logikę wewnętrzną. Jeśli zostaną przesłane do formularza zewnętrznego, mogą zostać ujawnione.

W 2023 roku inżynierowie Samsunga przez pomyłkę wkleili wewnętrzny kod źródłowy i notatki do ChatGPT (Forbes). Dane te mogą teraz stać się częścią przyszłych zestawów szkoleniowych, co stanowi poważne ryzyko dla własności intelektualnej.

- Naruszenia zgodnościPrzesyłanie danych osobowych (PII) za pośrednictwem formularza takiego jak OpenAI bez odpowiednich zabezpieczeń może stanowić naruszenie ogólnego rozporządzenia o ochronie danych (RODO), ustawy HIPAA lub zawartych umów.

Firma X Elona Muska przekonała się o tym na własnej skórze. Uruchomili oni swojego chatbota opartego na sztucznej inteligencji, „Grok”, wykorzystując wszystkie wpisy użytkowników, w tym te z Unii Europejskiej, do jego szkolenia, bez konieczności rejestracji. Organy regulacyjne szybko interweniowały. Pod presją wstrzymali szkolenie Groka w UE (Polityczny).

- niejasne zachowanieTrudno jest skorygować lub wyjaśnić działania agentów niedeterministycznych. Co się dzieje, gdy klient pyta, dlaczego chatbot udzielił błędnej rekomendacji lub ujawnił coś poufnego? Aby na to odpowiedzieć, potrzebna jest transparentność – a wielu agentów dziś jej nie zapewnia.

- Zamieszanie wokół własności danychKto jest właścicielem danych wyjściowych? Kto rejestruje dane? Czy dostawca usług ponownie szkoli na podstawie danych wejściowych?

Zoom został przyłapany na robieniu dokładnie tego w 2023 roku. Po cichu zmienili warunki korzystania z usługi, aby umożliwić wykorzystanie danych ze spotkań z klientami do szkolenia sztucznej inteligencji (Fast Company). Po fali krytyki ze strony opinii publicznej zmienili politykę, ale stało się to przypomnieniem, że zaufanie można stracić z dnia na dzień.

- Luki w zabezpieczeniach opakowaniaW 2024 roku odkryto dziesiątki wdrożeń Flowise – popularnego narzędzia do orkiestracji LLM o niskim kodzie – wystawionych na działanie Internetu, wiele z nich bez uwierzytelnienia (Wiadomości o cyberbezpieczeństwie). Naukowcy odkryli, że klucze API, dane uwierzytelniające bazy danych i dane użytkowników są dostępne publicznie. To nie problem OpenAI, to BudowniczowieAle cenę nadal płacą użytkownicy końcowi.

- Funkcje sztucznej inteligencji, które idą za dalekoFunkcja „Recall” firmy Microsoft – część wdrożenia Copilot – automatycznie rejestrowała zrzuty ekranu aktywności użytkowników, aby pomóc asystentowi AI w udzielaniu odpowiedzi na pytania (PodwójnyPulsar). Wydawało się to przydatne… dopóki eksperci ds. bezpieczeństwa nie zauważyli, że to koszmar dla prywatności. Microsoft musiał szybko się wycofać i uczynić tę funkcję jedynie opcjonalną.

Nie wszystko potrzebuje OpenAI.

OpenAI to niezwykle potężna platforma. Ale nie zawsze jest idealnym rozwiązaniem.

Czasami mniejszy, lokalny model jest całkowicie wystarczający. Innym razem lepiej sprawdza się logika oparta na regułach. Często najbezpieczniejszą opcją jest taka, która działa w całości w ramach własnej infrastruktury, zgodnie z własnymi regułami.

Nie powinniśmy po prostu ślepo podłączać dużego modelu językowego (LLM) i nazywać go „inteligentnym asystentem”.

W instytucjach, Zaufanie, przejrzystość i kontrola to nie są opcjonalne dodatki. - Raczej jest to konieczne.

Coraz więcej platform umożliwia tego typu kontrolę. Einstein 1 Studio firmy Salesforce obsługuje już tę funkcję. przynieś własny model, umożliwiając łączenie własnych dużych modeli językowych (LLM) z AWS lub Azure. IBM Watson umożliwia organizacjom wdrażanie modeli lokalnie z pełnymi śladami audytu. Databricks, z MosaicML, umożliwia trenowanie prywatnych dużych modeli językowych (LLM) we własnej chmurze, dzięki czemu poufne dane nigdy nie opuszczają infrastruktury.

Tak powinna wyglądać prawdziwa sztuczna inteligencja w przedsiębiorstwie.

Wniosek

Agenci AI są niezwykle potężni, umożliwiając przepływy pracy i automatyzację, które wcześniej były nieosiągalne. Jednak łatwość tworzenia oprogramowania niekoniecznie oznacza bezpieczeństwo, zwłaszcza w przypadku przetwarzania wrażliwych danych na dużą skalę.

Zanim zaczniesz używać tego nowego, błyszczącego środka, zadaj sobie następujące pytania:

- Kto kontroluje model?

- Gdzie trafiają dane?

- Czy działamy zgodnie z przepisami?

- Czy możemy sprawdzić, co on robi?

W dobie sztucznej inteligencji największym zagrożeniem nie jest zła technologia, ale Ślepe zaufanie.

O autorze

Nazywam się Elaine, jestem inżynierką uczenia maszynowego z sześcioletnim doświadczeniem, obecnie pracuję w startupie fintech w San Francisco. Moje doświadczenie obejmuje role związane z analizą danych w doradztwie dla branży naftowej i gazowej, a także kierowanie programami szkoleniowymi z zakresu sztucznej inteligencji i danych w regionie Azji i Pacyfiku, na Bliskim Wschodzie i w Europie.

Aktualnie kończę studia magisterskie z Data Science (kończę je w maju 2025 r.) i aktywnie poszukuję nowej pracy jako inżynier uczenia maszynowego. Jeśli jesteś otwarty na polecenie lub kontakt, będę bardzo wdzięczny!

Uwielbiam wywierać realny wpływ na świat za pomocą sztucznej inteligencji i jestem otwarty na współpracę przy projektach.

Możliwość dodawania komentarzy nie jest dostępna.