Moje osobiste doświadczenie: uruchamianie prawdziwego chatbota opartego na sztucznej inteligencji lokalnie na iPhonie

Chatboty oparte na sztucznej inteligencji, takie jak: ChatGPT و Gemini...polegać na chmurze obliczeniowej, aby funkcjonować. A co, gdyby można było uruchomić model LLM (Large Language Model) bezpośrednio na iPhonie, bez konieczności subskrypcji, połączenia internetowego, a nawet przesyłania danych z urządzenia? Dzięki pakietowi lekkich, kompaktowych aplikacji i modeli jest to już możliwe.

Sam to wypróbowałem. Oto, co musisz wiedzieć.

Uruchom sztuczną inteligencję lokalnie na iPhonie

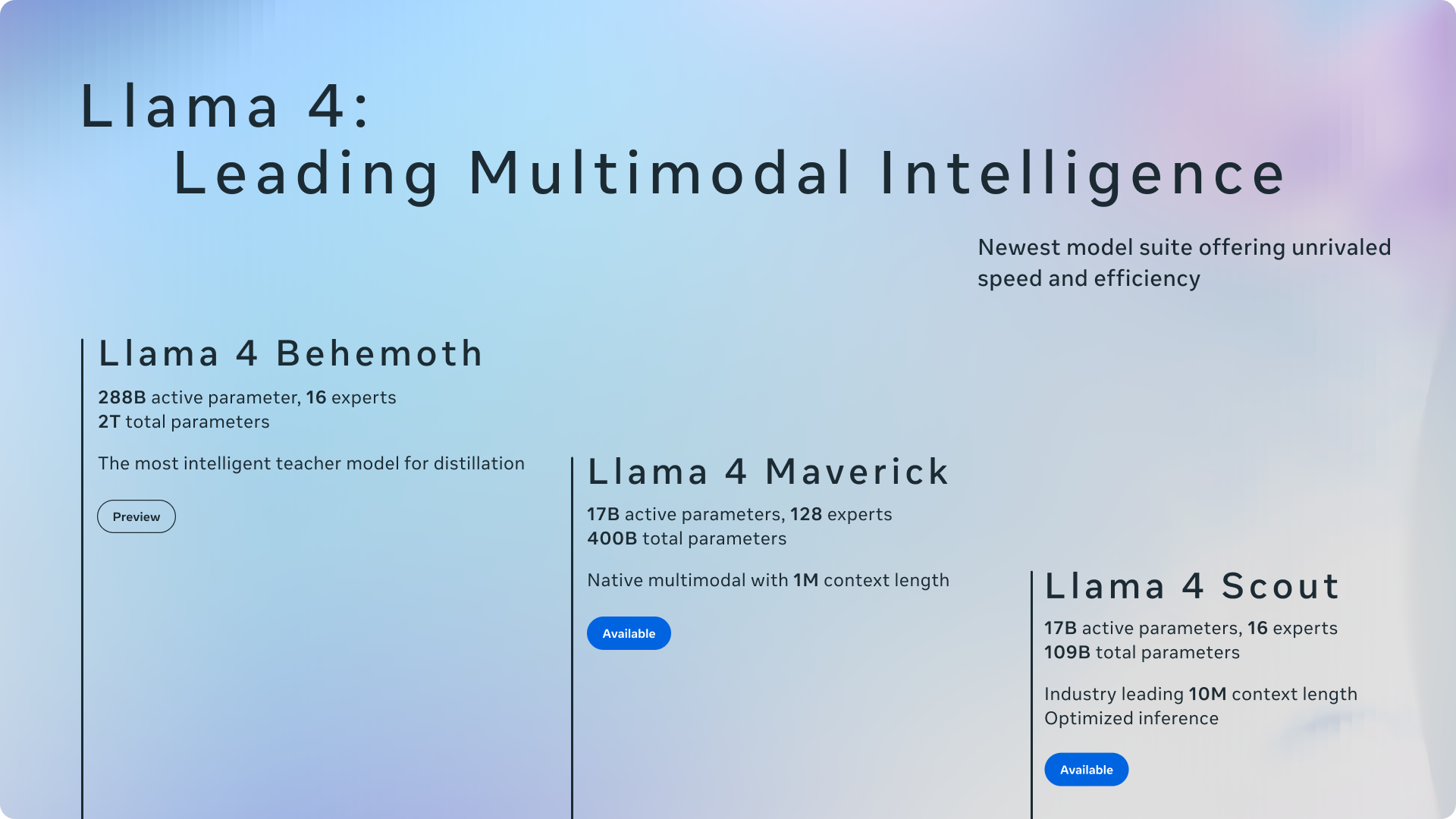

Teraz możesz uruchamiać modele open source, takie jak Lama و Qwen Bezpośrednio na iOS. Modele te są redukowane za pomocą procesu zwanego kwantyzacją, który kompresuje je tak, aby zmieściły się w pamięci urządzenia mobilnego bez znaczącego wpływu na wydajność.

Ale jest ważna kwestia: wydajność w dużej mierze zależy od urządzenia. Na przykład iPhone 15 Pro lub 15 Pro Max, wyposażony w najnowszy układ Apple, obsługuje modele z 7 lub 8 miliardami parametrów (takie jak Llama 3.1 8B), podczas gdy starsze telefony są bardziej odpowiednie dla mniejszych modeli z parametrami od 1 do 3 miliardów.

Aplikacje, które to umożliwiają

- LLM Farm (bezpłatnie): Najprostszy sposób na rozpoczęcie. Możesz pobrać mały model (np. Phi-3.5 Instruct) i uruchomić go offline jednym kliknięciem. Jest zaskakująco płynny w przypadku szybkich zapytań.

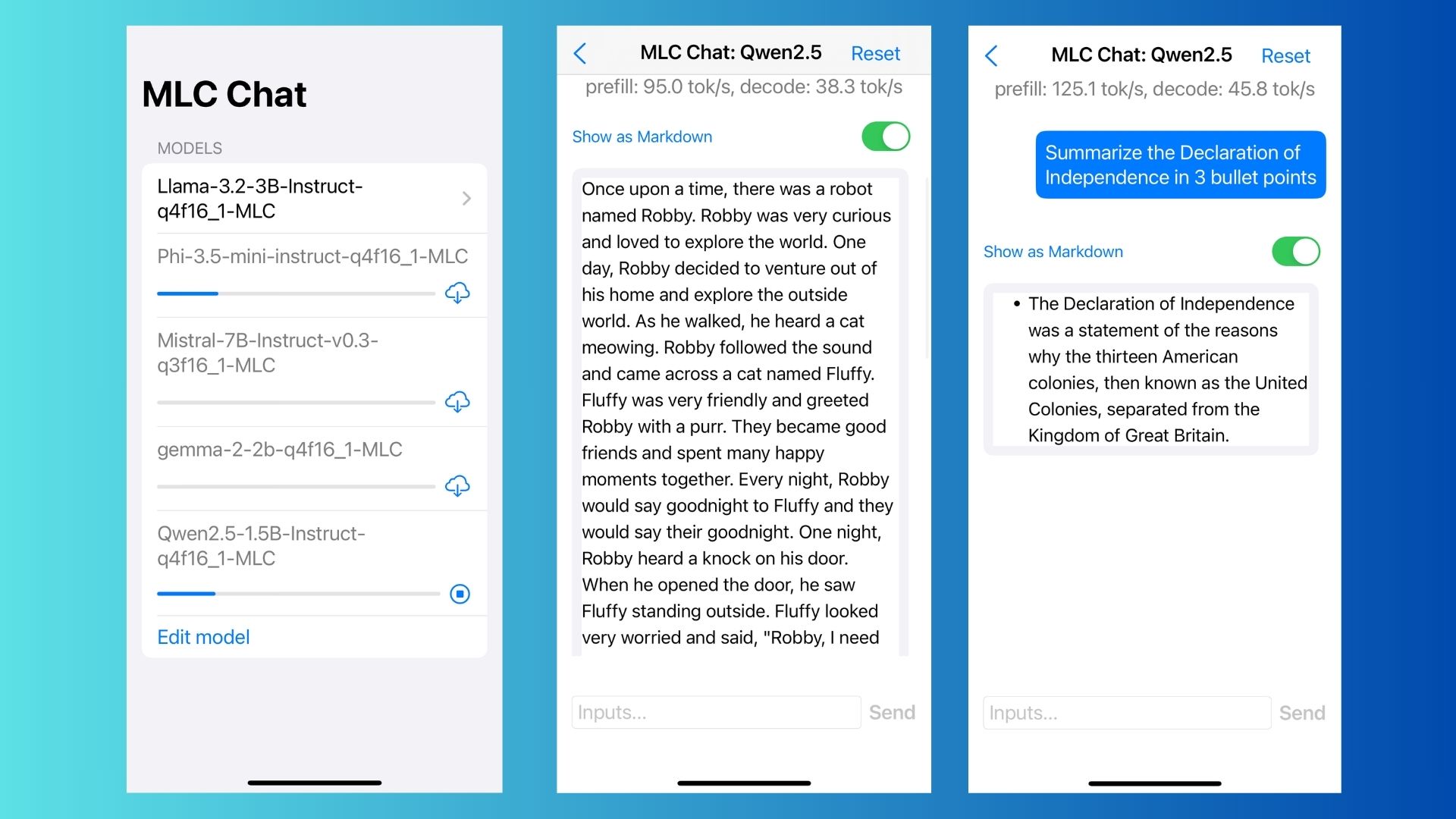

- Czat MLC (bezpłatny):

To jest aplikacja, której używałem. Chciałem wypróbować LLM Farm, ale z jakiegoś powodu nie była dostępna do pobrania w Apple App Store. Ponieważ jest darmowa, wypróbowałem ją i działała idealnie. - Prywatny LLM (projekt społeczny): Ta opcja to raczej projekt DIY niż dla przeciętnego użytkownika. Ta aplikacja zawiera szczegółowe instrukcje dotyczące pobierania modeli takich jak Llama 3.1 i Qwen na iPhone'a. Jeśli lubisz majsterkować i eksperymentować, zdecydowanie warto spróbować.

- Apollo (płatny): Słyszałem o niej dobre opinie, ale sam jej nie wypróbowałem. Dajcie znać w komentarzach, co sądzicie o tej aplikacji, która dba o prywatność.

Jak uruchomić model lokalnie

Po pobraniu wybranej aplikacji otwórz ją. Następnie przejrzyj listę wbudowanych modeli i wybierz jeden (na przykład Phi-3.5 Instruct Q4 quantized). Wybrałem Qwen 2.5 z prostego powodu – dawno go nie używałem.

Po pobraniu formularz pojawi się na Twoim urządzeniu (może mieć od kilkuset megabajtów do kilku gigabajtów, w zależności od rozmiaru). Stamtąd po prostu zacznij czatować.

Musisz być realistą; to nie jest czas na dogłębne analizy ani długie, szczegółowe plany. Rozważ następujące kwestie:

- prędkość: Mniejsze modele (1–3 miliardy parametrów) reagują szybciej, natomiast w przypadku dużych modeli każdy symbol może wymagać kilku sekund.

- Kontekst: Nie wklejaj całych artykułów; ogranicz długość podpowiedzi.

- Wyjście: Lokalne modele języka dużego mogą być mniej dokładne niż ChatGPT, ale są przydatne do robienia notatek, podsumowań, pytań i odpowiedzi oraz do prostego pisania.

Dobrze się bawiłem, testując niektóre z podpowiedzi. Nic skomplikowanego; moim celem było po prostu sprawdzenie, jakie odpowiedzi otrzymam na lokalne zapytanie. Jedną rzeczą, którą od razu zauważysz, jest szybkość. To niesamowite, jak szybko reaguje duży model językowy.

Wypróbowałem poniższe twierdzenia i ogólnie rzecz biorąc, spodobały mi się wyniki.

- Podsumuj Deklarację Niepodległości w trzech punktach.

- „Napisz krótką bajkę na dobranoc o robocie i kocie.”

- „Podaj mi trzy pomysły na obiad z kurczakiem, ryżem i brokułami.”

Prowadzenie dużego modelu języka lokalnego nie jest tym samym, co czatowanie CzatGPT-5Z pewnością wydaje się to uproszczone i prymitywne. Jeśli spróbujesz, pamiętaj, aby komunikaty były krótkie, ponieważ okna kontekstowe są znacznie bardziej ograniczone niż w przypadku standardowej wersji chatbota. Odczujesz, że odpowiedzi będą wolniejsze, jeśli przeciążysz lokalny, obszerny model językowy.

Dlaczego miałbyś to zrobić?

- Nie ma opłat abonamentowych. Nie musisz nadwyrężać swojego kredytu, żeby spróbować.

- Wbudowana prywatność. Wszystko pozostaje na Twoim urządzeniu.

- Zaskakująco wszechstronny. Byłem naprawdę zdumiony ilością zadań, z którymi poradziła sobie ta miniatura. Za każdym razem, gdy sprawdzałem jej granice, z łatwością sprostała wyzwaniu.

Podsumowując

Jeśli masz iPhone'a 15 lub nowszego i chcesz zobaczyć, jak wygląda sztuczna inteligencja „od środka”, zacznij od tego. Może być Farma LLM أو MLCChat Szybkie i darmowe sposoby na rozpoczęcie. Jeśli zależy Ci na prywatności, aplikacja Apollo Warto spróbować. Jeśli jesteś fanem eksperymentów i personalizacji, Prywatny LLM Umożliwia bardziej szczegółową analizę ustawień niestandardowych.

Pamiętaj tylko, że to nie są w pełni wydajne chatboty, do których jesteś przyzwyczajony, więc nie spodziewaj się wyników na poziomie ChatGPT. Ale uruchomienie własnej sztucznej inteligencji na iPhonie to całkiem fajne i futurystyczne rozwiązanie.

Możliwość dodawania komentarzy nie jest dostępna.