Jak sztuczna inteligencja zmienia codzienne zadania naukowców zajmujących się danymi

Od eliminowania zadań o niskiej wartości po przyspieszenie projektów o dużym wpływie — oto w jaki sposób sztuczna inteligencja zmienia przepływy pracy w nauce danych.

W moich poprzednich artykułach omawiałem i porównywałem kilka narzędzi AI, na przykład agenta Data Science firmy Google, ChatGPT kontra Claude kontra Gemini Do nauki o danych i DeepSeek V3, itd. Jest to jednak tylko niewielki podzbiór wszystkich dostępnych narzędzi sztucznej inteligencji. Nauka danychNa przykład niektóre narzędzia, których używałem w swojej pracy:

- API OpenAI:Używam go do kategoryzowania i podsumowywania opinii klientów oraz identyfikowania słabych punktów produktu.

- ChatGPT و GeminiPomagają mi pisać wiadomości i e-maile na Slacku, raporty analityczne, a nawet oceny wydajności.

- czyste AI:Glean wykorzystał sztuczną inteligencję, aby szybko znaleźć odpowiedzi w dokumentach i komunikacji wewnętrznej.

- Kursor و Drugi pilot: Lubię po prostu naciskać Tab-Tab, aby automatycznie uzupełnić kod i komentarze.

- Magia zaklęćUżywam Hex do współpracy z arkuszami kalkulacyjnymi w pracy. Oferuje on również funkcję o nazwie Magia zaklęć Pisanie kodu i naprawianie błędów przy użyciu sztucznej inteligencji konwersacyjnej.

- Kora płatka śnieguCortex AI umożliwia użytkownikom wywoływanie punktów końcowych LLM, tworzenie grup RAG i usług konwersji tekstu na SQL przy użyciu danych w Snowflake.

Jestem pewien, że można by do tej listy dodać jeszcze więcej, a nowe narzędzia AI pojawiają się każdego dnia. W tej chwili stworzenie pełnej listy jest praktycznie niemożliwe. Dlatego w tym artykule chciałbym się cofnąć i skupić na ważniejszym pytaniu: Czego naprawdę potrzebujemy jako specjaliści od danych i w jaki sposób sztuczna inteligencja może nam w tym pomóc?؟

W poniższej sekcji skupię się na dwóch głównych trendach – eliminowaniu zadań o niskiej wartości i przyspieszaniu pracy o wysokiej wartości.

1. Eliminuj zadania o niskiej wartości

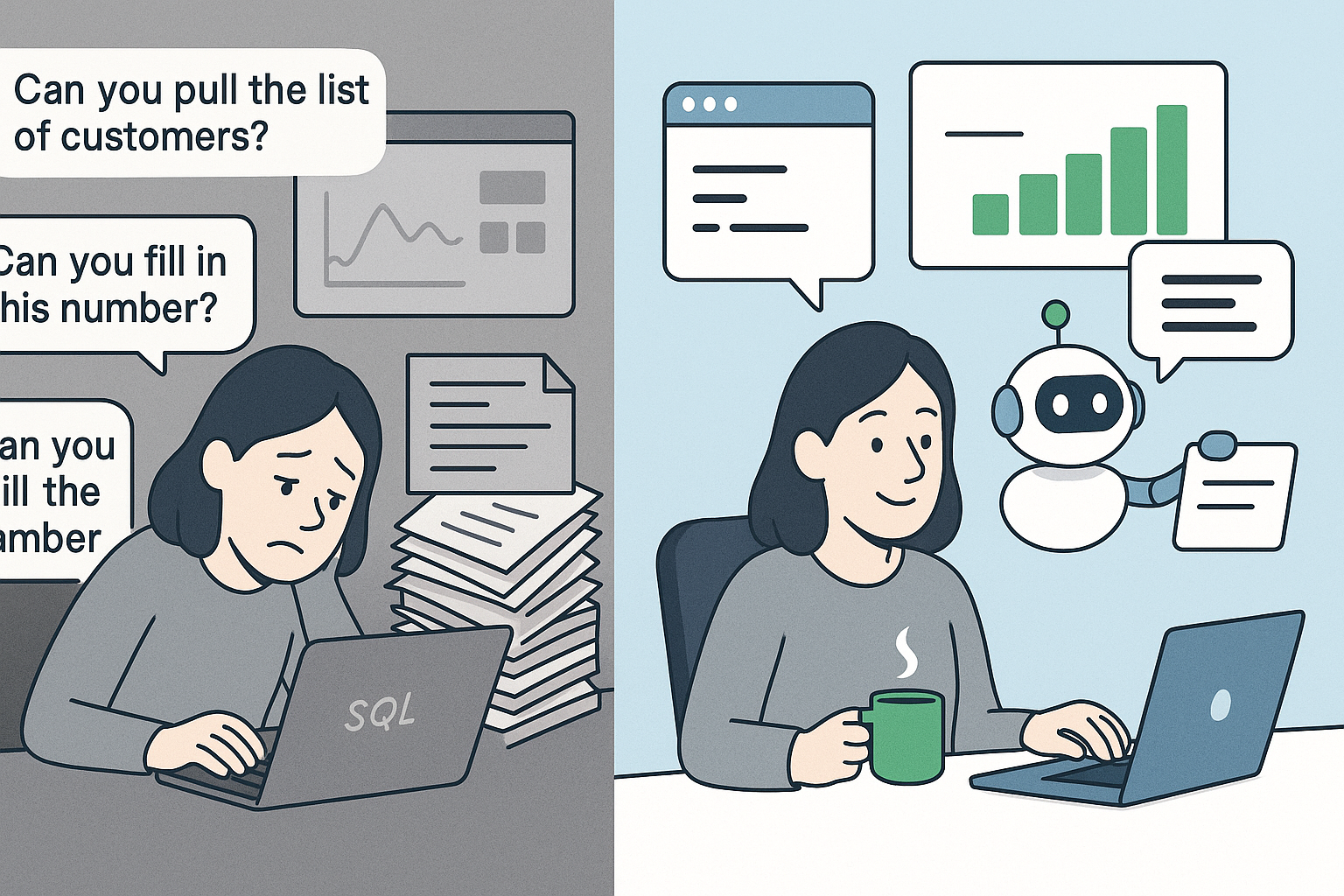

Zostałem analitykiem danych, ponieważ naprawdę lubię odkrywać wnioski biznesowe ze złożonych danych i podejmować decyzje biznesowe na ich podstawie. Jednak po ponad siedmiu latach pracy w tej dziedzinie muszę przyznać, że nie każda praca jest tak ekscytująca, jak się spodziewałem. Zanim zaczniemy wykonywać zaawansowane analizy lub budować modele uczenia maszynowego, istnieje wiele mało wartościowych przepływów pracy, których nie da się uniknąć na co dzień – a w wielu przypadkach wynika to z braku odpowiednich narzędzi, które umożliwiłyby naszym interesariuszom samoobsługową analizę. Przyjrzyjmy się naszej obecnej sytuacji i idealnemu scenariuszowi:

Status aktualny: Działamy jako interpretatorzy i strażnicy danych (czasami „małpy SQL”)

- Proste żądania ściągnięcia danych Co tydzień przychodzi do mnie i mojego zespołu na Slacku i pyta: „Jaka była Wasza wartość brutto (GMV) w zeszłym miesiącu?”, „Czy możesz wyświetlić listę klientów, którzy spełniają te kryteria?”, „Czy możesz mi pomóc wpisać tę liczbę do prezentacji, którą muszę jutro wygłosić?”.

- Narzędzia Business Intelligence (BI) nie sprawdzają się dobrze w przypadku zastosowań samoobsługowych.Wdrożyliśmy narzędzia Business Intelligence, takie jak Looker i Tableau, aby interesariusze mogli łatwo analizować dane i monitorować metryki. Prawda jest jednak taka, że zawsze istnieje kompromis między prostotą a możliwością samoobsługi. Czasami tworzymy łatwe do zrozumienia pulpity nawigacyjne z kilkoma metrykami, ale sprawdzają się one tylko w ograniczonej liczbie przypadków użycia. Z kolei, jeśli narzędzie będzie wysoce konfigurowalne i umożliwi swobodne analizowanie metryk i danych bazowych, interesariusze mogą uznać je za mylące i nie mieć pewności, czy z niego korzystać. W najgorszym przypadku dane zostaną pobrane i błędnie zinterpretowane.

- Dokumentów jest niewiele lub są nieaktualne.To częsta sytuacja, ale może mieć ona różne przyczyny – być może działamy szybko i koncentrujemy się na osiąganiu rezultatów, albo nie mamy solidnej dokumentacji danych i zasad zarządzania nimi. W rezultacie wiedza plemienna staje się wąskim gardłem dla osób spoza zespołu ds. danych, które nie mogą z niej korzystać.

Idealny przypadek: Umożliwienie interesariuszom samodzielnej obsługi, abyśmy mogli ograniczyć pracę o niskiej wartości

- Interesariusze mogą z łatwością i pewnością wykonywać proste operacje pobierania danych i odpowiadać na podstawowe pytania dotyczące danych.

- Zespoły zajmujące się danymi spędzają mniej czasu na przygotowywaniu powtarzalnych raportów lub prostych jednorazowych zapytań.

- Panele można łatwo znaleźć, zinterpretować i wykonać za ich pomocą działania bez konieczności bezpośredniej pomocy.

A zatem, aby przybliżyć się do idealnego przypadku, jaką rolę może odegrać sztuczna inteligencja? Z moich obserwacji wynika, że narzędzia sztucznej inteligencji zmierzają w następujących kierunkach, aby wypełnić tę lukę:

- Zapytanie o dane w języku naturalnym (tekst-SQL)Jednym ze sposobów na obniżenie bariery technicznej jest umożliwienie interesariuszom wyszukiwania danych w języku naturalnym. W branży istnieje wiele inicjatyw w zakresie przetwarzania tekstu na SQL:

- na przykład, Snowflake Jest to jedna z firm, która osiągnęła duży postęp w Modele Text2SQL I zaczął integrować tę możliwość ze swoim produktem.

- Wiele firm (w tym moja) również testowało rozwiązania Text2SQL u siebie. Na przykład brałem udział w Uber Jej podróż z QueryGPT Ubera Aby ułatwić zespołowi operacyjnemu wyszukiwanie danych, artykuł szczegółowo opisuje, jak Uber zaprojektował architekturę wieloagentową do generowania zapytań. Jednocześnie ujawniono istotne wyzwania w tym obszarze, takie jak precyzyjna interpretacja intencji użytkownika, obsługa dużych schematów tabel, unikanie halucynacji i wiele innych.

- Szczerze mówiąc, aby przetwarzanie tekstu na SQL działało, wymagany jest bardzo wysoki poziom rygorystycznej walidacji zapytań – nawet jeśli narzędzie zawiedzie tylko raz, może to zniszczyć zaufanie, a w końcu interesariusze będą musieli wrócić do Ciebie, aby zweryfikować zapytania (a Ty będziesz musiał je odczytać i przepisać, co niemal podwoi pracę :)). Do tej pory nie znalazłem modelu ani narzędzia do przetwarzania tekstu na SQL, które działałoby idealnie. Uważam, że jest to możliwe tylko wtedy, gdy przeszukujesz bardzo mały podzbiór dobrze udokumentowanych bazowych zbiorów danych dla konkretnych, standardowych przypadków użycia, ale bardzo trudno jest skalować je tak, aby obejmowało wszystkie dostępne dane i różne scenariusze biznesowe.

- Ale oczywiście, biorąc pod uwagę ogromne inwestycje w tej dziedzinie i szybki rozwój sztucznej inteligencji, jestem pewien, że będziemy coraz bliżej dokładnych i skalowalnych rozwiązań Text-to-SQL.

- Asystent BI oparty na czacieInnym popularnym sposobem na poprawę doświadczeń interesariuszy z narzędziami Business Intelligence jest asystent Business Intelligence oparty na czacie. To w rzeczywistości idzie o krok dalej w dziedzinie przetwarzania tekstu na SQL – zamiast generować zapytanie SQL na podstawie monitu użytkownika, odpowiada w formie wizualizacji wraz z podsumowaniem tekstowym.

- Bliźnięta w Lookerze Oto przykład. Looker należy do Google, więc integracja z Gemini jest dla nich naturalnym wyborem. Kolejną zaletą Lookera w kontekście tworzenia sztucznej inteligencji jest to, że pola danych są już udokumentowane w warstwie semantycznej LookML, a wspólne mapowania i metryki są wbudowane w pulpity nawigacyjne. Można więc czerpać z niego mnóstwo cennych informacji. Gemini pozwala użytkownikom na precyzyjne dostrajanie pulpitów nawigacyjnych Lookera, zadawanie pytań dotyczących danych, a nawet tworzenie niestandardowych agentów danych do analityki konwersacyjnej. Jednak, bazując na moim ograniczonym doświadczeniu z tym narzędziem, często nie odpowiada ono na proste pytania. Dajcie znać, czy mieliście inne doświadczenia i udało Wam się je uruchomić…

- Tableau uruchomiło również podobną funkcję, Tabela AISam z tego nie korzystałem, ale na podstawie wersji demonstracyjnej mogę powiedzieć, że narzędzie to pomaga zespołowi ds. danych przygotowywać dane, szybko tworzyć pulpity nawigacyjne z wykorzystaniem języka naturalnego oraz podsumowywać spostrzeżenia dotyczące danych w programie Tableau Pulse, dzięki czemu interesariusze mogą łatwo identyfikować zmiany metryk i nietypowe trendy.

- Narzędzia do indeksowania danychSztuczna inteligencja może również pomóc pokonać wyzwanie związane z brakiem aktualnej dokumentacji danych.

- Podczas wewnętrznego hackathonu pamiętam, że jednym z projektów, nad którymi pracowali nasi inżynierowie danych, było wykorzystanie LLM do zwiększenia pokrycia dokumentacji tabel. Sztuczna inteligencja potrafi odczytać bazę kodu i w większości przypadków opisać kolumny z dużą dokładnością, co pozwala jej szybko ulepszyć dokumentację przy ograniczonej walidacji i modyfikacji ze strony człowieka.

- Podobnie, gdy mój zespół tworzy nowe tabele, zaczęliśmy prosić Cursor o napisanie plików YAML z dokumentacją tabeli, co pozwalało nam zaoszczędzić czas i uzyskać wysokiej jakości wyniki.

- Istnieje również wiele indeksów danych i narzędzi do zarządzania, które zostały zintegrowane ze sztuczną inteligencją. Kiedy wpisuję w Google hasło „indeks danych AI”, widzę loga narzędzi do indeksowania danych, takich jak Atlan, Alation, Collibra, Informatica i tak dalej (zastrzeżenie: nie korzystałem z żadnego z nich). To wyraźny trend branżowy.

2. Przyspiesz pracę o wysokiej wartości

Skoro omówiliśmy już, jak sztuczna inteligencja może pomóc w eliminacji zadań o niskiej wartości, omówmy teraz, jak może przyspieszyć projekty danych o wysokiej wartości. „Praca o wysokiej wartości” odnosi się tutaj do projektów danych, które łączą doskonałość techniczną z kontekstem biznesowym i osiągają znaczący wpływ dzięki współpracy międzyfunkcyjnej. Na przykład, dogłębna analiza, która rozumie wzorce użytkowania produktu i prowadzi do jego zmian, lub model przewidywania odejść klientów, który identyfikuje klientów zagrożonych odejściem i prowadzi do inicjatyw zapobiegających odejściu. Porównajmy stan obecny z idealną przyszłością:

Stan obecny: Istnieją wąskie gardła w Wydajność W codziennym przepływie pracy

- Eksploracyjna analiza danych (EDA) jest czasochłonna.Ten krok jest niezbędny do wstępnego zrozumienia danych, jednak przeprowadzenie wszelkich analiz jednowymiarowych i wielowymiarowych może być czasochłonne.

- Czas stracony na kodowanie i debugowanieBądźmy szczerzy — nikt nie pamięta wszystkich konstrukcji numpy, pandas i parametrów modelu sklearn. Podczas kodowania ciągle musimy szukać w dokumentacji.

- Bogate i niestrukturyzowane dane nie są w pełni wykorzystywane.Firmy codziennie generują mnóstwo danych tekstowych z ankiet, zgłoszeń do pomocy technicznej i recenzji. Jednak wydobycie skalowalnych wniosków pozostaje wyzwaniem.

Idealny przypadek: naukowcy zajmujący się danymi skupiają się na głębokim myśleniu, a nie składni.

- Pisanie kodu wydaje się szybsze, gdy nie trzeba szukać składni.

- Analitycy poświęcają więcej czasu na interpretację wyników, a mniej na pracę z danymi.

- Niestrukturyzowane dane nie stanowią już bariery i można je szybko analizować.

Kiedy widzisz idealny przypadek, jestem pewien, że masz już na myśli jakieś narzędzia AI. Zobaczmy, jak sztuczna inteligencja może faktycznie wpłynąć na rzeczywistość lub coś zmienić:

- Asystenci AI do kodowania i debugowaniaMyślę, że to zdecydowanie najszerzej stosowany typ narzędzia AI dla każdego, kto programuje. I już widzimy jego replikację.

- Kiedy chatboty LLM, takie jak ChatGPT و ClaudeInżynierowie zdali sobie sprawę, że mogą po prostu zadawać chatbotowi pytania dotyczące składni lub komunikaty o błędach, który następnie otrzymywał bardzo dokładne odpowiedzi. Nadal stanowiło to zakłócenie procesu kodowania, ale było o wiele lepsze niż klikanie w dziesiątki zakładek StackOverflow – a to już wydaje się być minionym stuleciem.

- Później widzimy, że pojawiają się narzędzia do kodowania zintegrowanej sztucznej inteligencji Plus i Plus – zintegrowane Drugi pilot GitHub و Kursor Za pomocą edytora kodu mogą oni odczytać Twoją bazę kodu i proaktywnie sugerować uzupełnianie kodu oraz problemy związane z debugowaniem w Twoim środowisku IDE.

- Jak wspomniałem na początku, narzędzia do analizy danych, takie jak Snowflake و Hex Zawiera również asystentów kodowania AI, którzy pomagają analitykom i naukowcom zajmującym się danymi w łatwym pisaniu kodu.

- Sztuczna inteligencja do eksploracyjnej analizy danych i analizyJest to nieco podobne do narzędzi asystenta BI opartych na czacie, o których wspomniałem powyżej, ale jego cel jest bardziej ambitny – zaczyna od surowych zbiorów danych i ma na celu zautomatyzowanie całego cyklu analizy, obejmującego czyszczenie danych, wstępne przetwarzanie, analizę eksploracyjną, a czasem nawet modelowanie. To właśnie te narzędzia są często reklamowane jako „zastępujące analityków danych” (ale czy na pewno?).

- Agent Google Data Science To bardzo imponujące nowe narzędzie, które pozwala utworzyć cały notatnik Jupyter za pomocą prostego polecenia. Niedawno napisałem Artykuł Wyjaśnia, co może, a czego nie może zrobić. Krótko mówiąc, potrafi szybko utworzyć dobrze zorganizowany notatnik Jupyter Notebook, który działa w oparciu o konfigurowalny plan wykonania. Brakuje mu jednak możliwości modyfikacji notatnika Jupyter Notebook na podstawie pytań uzupełniających, nadal wymaga osoby z rozległą wiedzą z zakresu data science do weryfikacji metod i przeprowadzania ręcznych iteracji oraz jasnego określenia problemu z danymi za pomocą czystych, dobrze udokumentowanych zestawów danych. Dlatego uważam go za świetne narzędzie, które pozwala zaoszczędzić czas na początkowym kodzie, zamiast narażać nasze zadania na szwank.

- Można go również sklasyfikować jako Narzędzie do analizy danych ChatGPT W tym obszarze użytkownicy mogą przesłać zbiór danych i porozmawiać z nim, aby dokończyć analizę, stworzyć wizualizacje i odpowiedzieć na pytania. W moim poprzednim artykule opisującym możliwości tej funkcji można znaleźć: TutajSystem ten staje przed podobnymi wyzwaniami i lepiej sprawdza się jako asystent EDA niż jako zastępca analityka danych.

- Możliwości przetwarzania języka naturalnego są łatwe w użyciu i skalowalne.. LLM świetnie nadaje się do prowadzenia rozmów. Dlatego NLP stało się znacznie łatwiejsze dzięki dzisiejszemu LLM.

- Moja firma co roku organizuje wewnętrzny hackathon. Pamiętam, że mój projekt hackathonu trzy lata temu polegał na próbie wykorzystania BERT i innych tradycyjnych metod modelowania tematów do analizy odpowiedzi z ankiety NPS. To było fajne, ale szczerze mówiąc, bardzo trudno było to zrobić dokładnie i sensownie dla firmy. Dwa lata temu, podczas hackathonu, próbowaliśmy… API OpenAI Klasyfikowanie i podsumowywanie samych danych zwrotnych działało bez zarzutu, umożliwiając precyzyjne modelowanie tematyczne, analizę sentymentu i klasyfikację informacji zwrotnych w jednym wywołaniu API, a dane wyjściowe dobrze wpisywały się w nasz kontekst biznesowy w oparciu o komunikaty systemowe. Później zbudowaliśmy wewnętrzny kanał, który z łatwością rozszerzyliśmy o dane tekstowe z odpowiedzi ankietowych, zgłoszeń do pomocy technicznej, rozmów handlowych, notatek z badań użytkowników itp. Stał się on centralnym punktem informacji zwrotnej od klientów i wpłynął na nasz plan rozwoju produktu. Plus znajdziesz na stronie Ten techniczny blog.

- Istnieje również wiele nowych firm tworzących narzędzia do analizy opinii klientów, narzędzia do analizy recenzji produktów, narzędzia dla asystentów obsługi klienta itp. oparte na sztucznej inteligencji. Wszystkie pomysły są podobne – wykorzystanie możliwości LLM w zakresie rozumienia kontekstu tekstu i prowadzenia rozmów do tworzenia agentów AI specjalizujących się w analizie tekstu.

Wniosek

Łatwo jest dać się porwać pogoni za najnowszymi narzędziami sztucznej inteligencji (AI). Ostatecznie jednak najważniejsze jest wykorzystanie AI do eliminowania tego, co nas spowalnia, i przyspieszania tego, co nas napędza. Kluczem jest pragmatyczne podejście: wdrażaj to, co działa dzisiaj, bądź ciekawy tego, co się pojawia, i nigdy nie trać z oczu głównego celu nauki o danych – podejmowania lepszych decyzji dzięki lepszemu zrozumieniu.

Możliwość dodawania komentarzy nie jest dostępna.