Google wprowadza Gemini 2.0 Pro i Flash-Lite, łącząc Flash Thinking z YouTube, Mapami i wyszukiwarką

Seria dużych modeli językowych (LLM) Gemini firmy Google miała trudny start prawie rok temu z powodu kilku żenujących, błędnie generowanych obrazów, ale od tego czasu są one stale udoskonalane, a firma najwyraźniej zamierza uczynić swoją drugą generację — Gemini 2.0 — największą i najlepszą jak dotąd dla konsumentów i firm.

Dziś, Ogłoszony Firma ogłosiła publiczną premierę Gemini 2.0 Flash, przedstawiła Gemini 2.0 Flash-Lite i wydała wersję beta Gemini 2.0 Pro.

Modele te, opracowane z myślą o wsparciu deweloperów i przedsiębiorstw, są teraz dostępne za pośrednictwem Google AI Studio i Vertex AI, Flash-Lite jest dostępny w publicznej wersji zapoznawczej, a wersja Pro dostępna jest do wczesnych testów.

„Wszystkie te modele będą wyposażone w wejście multimedialne z wyjściem tekstowym w momencie premiery, a w nadchodzących miesiącach do powszechnego użytku będzie można uzyskać dostęp do multimediów Plus” – napisał dyrektor techniczny Google DeepMind Koray Cavukcioglu we wpisie na blogu firmy ogłaszającym tę zapowiedź – co pokazuje przewagę, jaką Google oferuje nawet w obliczu takich konkurentów jak DeepSeek و OpenAI Wprowadzając na rynek silnych konkurentów.

Google wykorzystuje swoje możliwości multimedialne

Ani DeepSeek-R1 ani Nowy model o3-mini firmy OpenAI Akceptuj dane multimedialne – np. obrazy, przesyłane pliki i załączniki.

Chociaż model R1 może je akceptować na swojej stronie internetowej i w aplikacji mobilnej do czatu, wykorzystuje optyczne rozpoznawanie znaków (OCR), technologię znaną od ponad 60 lat, aby wyodrębnić z przesłanych plików wyłącznie tekst – i nie rozumie ani nie analizuje żadnych innych zawartych w nich funkcji.

Oba modele reprezentują jednak nową klasę modeli „rozumowania”, które celowo wymagają więcej czasu na przemyślenie odpowiedzi i zastanowienie się nad „łańcuchami myślowymi” oraz trafnością swoich reakcji. Jest to kontrast z typowymi modelami dużego języka, takimi jak seria Gemini 2.0 pro, więc porównywanie Gemini 2.0, DeepSeek-R1 i OpenAI o3 jest jak porównywanie jabłek z pomarańczami.

Ale dziś pojawiły się też pewne informacje dotyczące strony myślowej Google: dyrektor generalny Google, Sundar Pichai, ogłosił za pośrednictwem Platforma X O aktualizacji aplikacji Google Bliźnięta Na urządzenia mobilne z systemem iOS i Android dostępny jest model Gemini 2.0 Flash Thinking. Model ten można połączyć z Mapami Google, YouTube i wyszukiwarką Google, co umożliwia zupełnie nowy zestaw wyszukiwań i interakcji opartych na sztucznej inteligencji, z którymi nowi konkurenci, tacy jak DeepSeek i OpenAI, nie mogą się równać bez tych usług.

Krótko wypróbowałem aplikację Google Gemini iOS na moim iPhonie podczas pisania tego artykułu i muszę przyznać, że zrobiła na mnie duże wrażenie, biorąc pod uwagę moje początkowe zapytania: znaleziono podobieństwa między 10 najchętniej oglądanymi filmami na YouTube w ostatnim miesiącu, a także w ciągu kilku sekund wyświetlono mi listę pobliskich gabinetów lekarskich wraz z godzinami ich otwarcia i zamknięcia.

Gemini 2.0 Flash – publiczne wydanie

Model Gemini 2.0 Flash, początkowo wprowadzony na rynek jako wersja beta, stał się W grudniu, gotowe do produkcji już teraz.

Zaprojektowany z myślą o wysoce wydajnych zastosowaniach sztucznej inteligencji, zapewnia odpowiedzi o niskim opóźnieniu i obsługuje wnioskowanie multimodalne na dużą skalę.

Jedną z jego głównych zalet w porównaniu z konkurencją jest okno kontekstowe, czyli liczba tokenów, które użytkownik może dodać jako zachętę i otrzymać w zamian w ramach pojedynczej interakcji z chatbotem lub interfejsem API obsługiwanym przez LLM.

Podczas gdy wiele wiodących modeli, takich jak nowy o3-mini firmy OpenAI, który zadebiutował w zeszłym tygodniu, obsługuje 200 000 tokenów lub mniej — co odpowiada 400-500-stronicowej powieści — Gemini 2.0 Flash obsługuje 1 milion tokenów, co oznacza, że może przetwarzać ogromne ilości informacji, a przez to jest szczególnie przydatny w przypadku zadań o dużej częstotliwości i skali.

Gemini 2.0 Flash-Lite: niedrogie rozwiązania AI

Gemini 2.0 Flash-Lite to zupełnie nowy model wielojęzykowy, którego celem jest dostarczanie ekonomicznych rozwiązań z zakresu sztucznej inteligencji bez uszczerbku dla jakości.

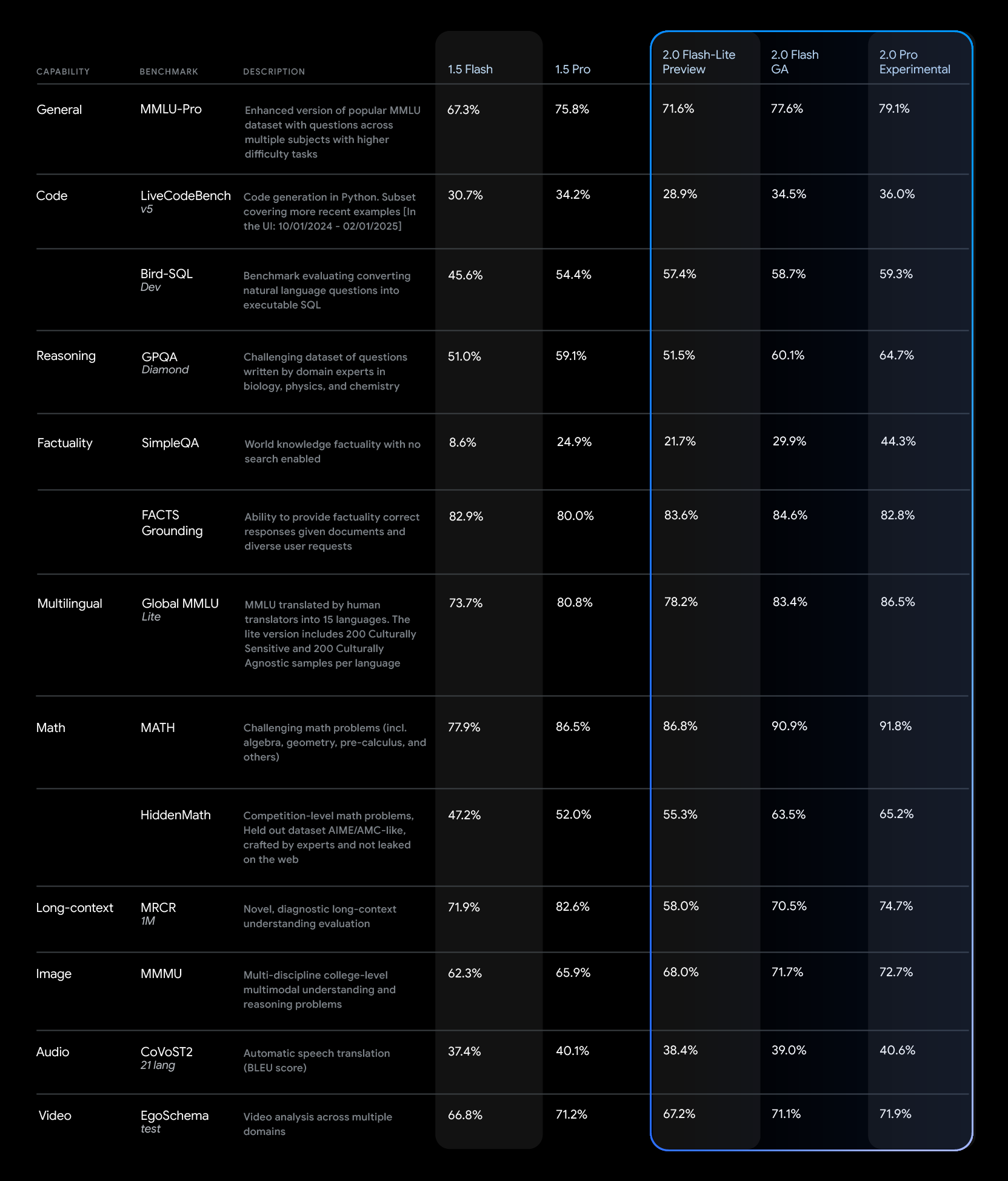

Google DeepMind podaje, że Flash-Lite przewyższa swojego pełnowymiarowego (bardziej sparametryzowanego) poprzednika, Gemini 1.5 Flash, w zewnętrznych testach porównawczych, takich jak MMLU Pro (77.6% w porównaniu do 67.3%) i Bird SQL (57.4% w porównaniu do 45.6%), przy zachowaniu tej samej ceny i szybkości.

Obsługuje także dane wejściowe multimedialne i posiada okno kontekstowe mieszczące 1 milion tokenów, podobnie jak pełny model Flash.

Aplikacja Flash-Lite jest obecnie dostępna w publicznej wersji zapoznawczej za pośrednictwem Google AI Studio i Vertex AI. Powszechna dostępność spodziewana jest w nadchodzących tygodniach.

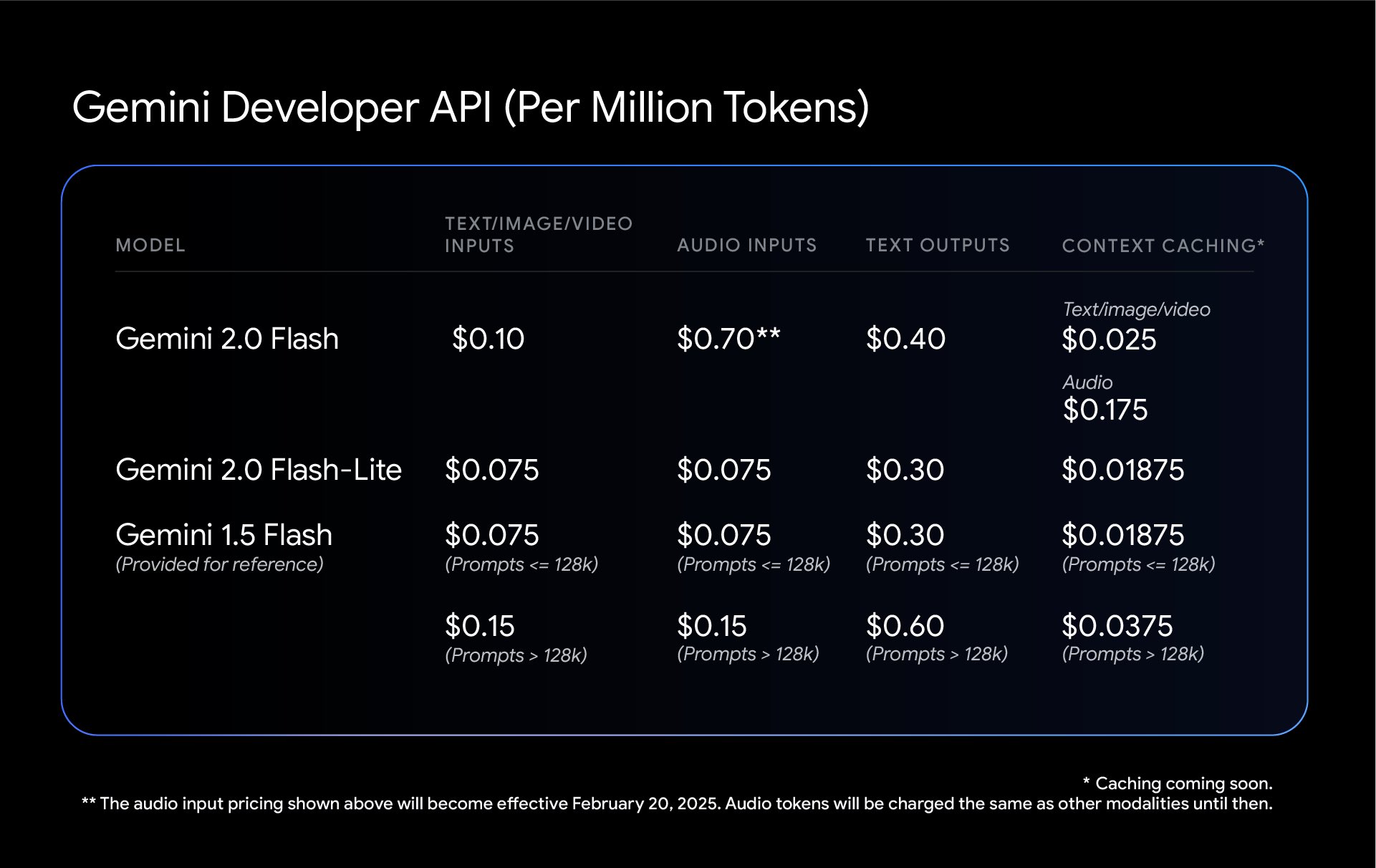

Jak pokazano w poniższej tabeli, Gemini 2.0 Flash-Lite kosztuje 0.075 USD za milion tokenów (wejścia) i 0.30 USD za milion tokenów (wyjścia). Flash-Lite to bardzo przystępna cenowo opcja dla programistów, przewyższająca Gemini 1.5 Flash w większości testów porównawczych, przy zachowaniu tej samej struktury kosztów.

Logan Kilpatrick podkreślił koszt i wartość modeli Gemini 2.0 Flash, ponieważ Mężczyzna na platformie X„Gemini 2.0 Flash oferuje najlepszy stosunek jakości do ceny spośród wszystkich modeli LLM. Czas zacząć budowę!”

W rzeczywistości, w porównaniu do innych wiodących tradycyjnych modeli LLM dostępnych za pośrednictwem interfejsu API dostawcy, takich jak OpenAI 4o-mini (0.15 USD/0.6 USD za milion tokenów I/O) i Antropiczny Claude (0.8/4 dolary za milion tokenów I/O), a nawet tradycyjny DeepSeek LLM V3 (0.14/0.28 dolara), Gemini 2.0 Flash wydaje się oferować najlepszy stosunek jakości do ceny.

Wersja beta Gemini 2.0 Pro z 2 milionami tokenów okna kontekstowego

Model Gemini 2.0 Pro (beta) jest już dostępny do testowania dla użytkowników potrzebujących bardziej zaawansowanych funkcji sztucznej inteligencji.

Google DeepMind opisuje ten model jako swój najpotężniejszy model pod względem wydajności programowania i możliwości obsługi złożonych zapytań. Oferuje on okno kontekstowe o pojemności 2 milionów znaków i ulepszone funkcje wnioskowania, z możliwością integracji z narzędziami zewnętrznymi, takimi jak wyszukiwarka Google, oraz wykonywania kodu.

Sam Witteveen, współzałożyciel i dyrektor generalny Red Dragon AI oraz zewnętrzny ekspert ds. rozwoju uczenia maszynowego w Google, który często współpracuje z VentureBeat, omówił: Profesjonalna modelka w recenzji na YouTube„Nowy model Gemini 2.0 Pro ma okno kontekstowe z 2 milionami ikon, obsługuje widżety, wykonywanie kodu, wywoływanie funkcji i integrację z wyszukiwarką Google — wszystko, co mieliśmy w wersji Pro 1.5, ale ulepszone”.

Zwrócił również uwagę na iteracyjne podejście Google do rozwoju sztucznej inteligencji: „Jedną z kluczowych różnic w strategii Google jest to, że firma udostępnia wersje beta modeli, zanim staną się one powszechnie dostępne (GA), co pozwala na szybką iterację na podstawie opinii”.

Testy wydajności dodatkowo potwierdzają możliwości rodziny modeli Gemini 2.0. Na przykład Gemini 2.0 Pro przewyższa Flash i Flash-Lite w zadaniach takich jak rozumowanie, rozumienie wielojęzyczne i przetwarzanie długokontekstowe.

Bezpieczeństwo sztucznej inteligencji i przyszłe kierunki rozwoju

Bezpieczeństwo sztucznej inteligencji i przyszłe kierunki rozwoju

Oprócz tych aktualizacji, Google DeepMind wdraża nowe środki bezpieczeństwa dla swoich modeli Gemini 2.0. Firma wykorzystuje techniki uczenia się przez wzmacnianie (reinforcement learning), aby zwiększyć dokładność odpowiedzi, wykorzystując sztuczną inteligencję do analizy i ulepszania wyników. Dodatkowo, automatyczne testy bezpieczeństwa służą do identyfikacji luk w zabezpieczeniach, w tym zagrożeń związanych z pośrednim wstrzykiwaniem roszczeń (indirect claim injection).

Patrząc w przyszłość, Google DeepMind planuje rozszerzyć możliwości rodziny modeli Gemini 2.0. W nadchodzących miesiącach spodziewane jest, że dodatkowe metody wykraczające poza tekst staną się powszechnie dostępne.

Dzięki tym aktualizacjom Google zwiększa zaangażowanie w rozwój sztucznej inteligencji (AI), wprowadzając zestaw modeli zaprojektowanych z myślą o wydajności, przystępności cenowej i zaawansowanym rozwiązywaniu problemów. Odpowiadając na rozwój DeepSeek, firma wprowadza własny zestaw modeli, od wydajnych i bardzo wydajnych, po bardzo przystępne cenowo i nieco tańsze (ale nadal przystępne cenowo).

Czy to wystarczy, by Google wkroczyło na rynek sztucznej inteligencji dla przedsiębiorstw, kiedyś zdominowany przez OpenAI, a teraz przez DeepSeek? Będziemy Was informować na bieżąco!

Jeśli chcesz zaimponować swojemu szefowi, VB Daily Ci w tym pomoże. Dostarczamy Ci informacji z pierwszej ręki na temat tego, co firmy robią z generatywną sztuczną inteligencją, od transformacji organizacyjnych po praktyczne wdrożenia, dzięki czemu możesz podzielić się swoimi spostrzeżeniami, aby zmaksymalizować zwrot z inwestycji (ROI).

Bezpieczeństwo sztucznej inteligencji i przyszłe kierunki rozwoju

Bezpieczeństwo sztucznej inteligencji i przyszłe kierunki rozwoju

Możliwość dodawania komentarzy nie jest dostępna.