Google znosi zakaz stosowania sztucznej inteligencji w broni i systemach nadzoru: niepokojąca przyszłość dla zaawansowanej technologii

Google zniosło długoletni zakaz stosowania sztucznej inteligencji w uzbrojeniu i systemach nadzoru, co sygnalizuje istotną zmianę w etycznym podejściu firmy do rozwoju sztucznej inteligencji. Zdaniem byłych pracowników i ekspertów branżowych może to zmienić podejście Doliny Krzemowej do bezpieczeństwa sztucznej inteligencji.

Ta zmiana, wprowadzona po cichu w tym tygodniu, eliminuje kluczowe części Zasady Google dotyczące sztucznej inteligencji które wyraźnie zabraniają firmie rozwijania sztucznej inteligencji na potrzeby broni lub nadzoru. Zasady te, Została założona w 2018 roku., stanowiąc branżowy punkt odniesienia w zakresie odpowiedzialnego rozwoju sztucznej inteligencji.

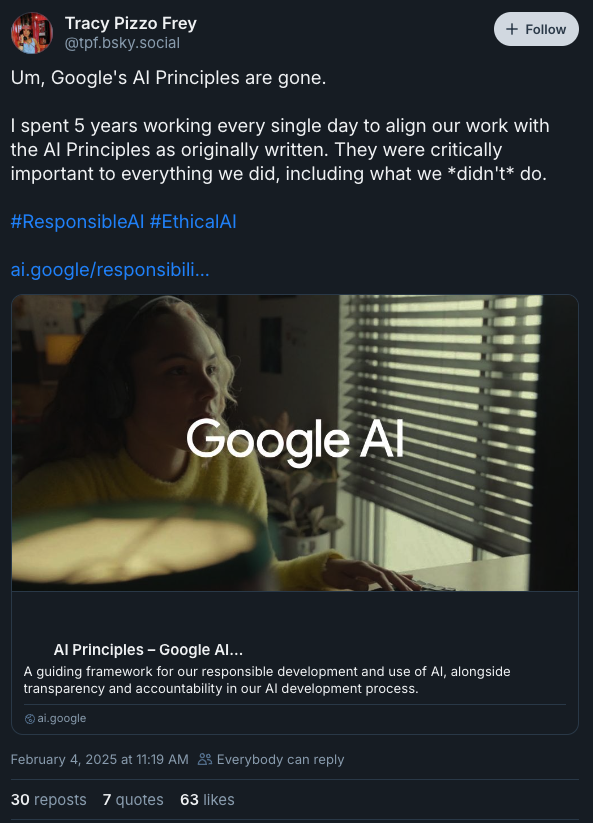

Tracy Pizzo-Fry, która przez pięć lat jako starsza dyrektor ds. zarządzania produktami wychodzącymi, zaangażowania i odpowiedzialnej sztucznej inteligencji w Google Cloud wdrażała natywne zasady sztucznej inteligencji firmy Google, napisała w poście na temat BlueSky„Ostatni bastion padł. Google jako jedyny tak jasno wyraził swoje zobowiązania wobec tego, co zamierza zbudować”.

Tracy Pizzo-Fry, która przez pięć lat jako starsza dyrektor ds. zarządzania produktami wychodzącymi, zaangażowania i odpowiedzialnej sztucznej inteligencji w Google Cloud wdrażała natywne zasady sztucznej inteligencji firmy Google, napisała w poście na temat BlueSky„Ostatni bastion padł. Google jako jedyny tak jasno wyraził swoje zobowiązania wobec tego, co zamierza zbudować”.

Zmienione zasady znoszą cztery konkretne zakazy: technologii mogących wyrządzić szkodę społeczeństwu, zastosowań broni, systemów nadzoru oraz technologii naruszających prawo międzynarodowe i prawa człowieka. Zamiast tego stanowią: Google Teraz będzie działać na rzecz „łagodzenia niezamierzonych lub szkodliwych skutków” i będzie zgodne z „powszechnie przyjętymi zasadami prawa międzynarodowego i praw człowieka”.

Google łagodzi ograniczenia etyczne dotyczące sztucznej inteligencji: co to oznacza dla technologii nadzoru i zastosowań wojskowych?

Ta zmiana następuje w szczególnie newralgicznym momencie, ponieważ możliwości sztucznej inteligencji gwałtownie się rozwijają, a dyskusje na temat odpowiednich mechanizmów kontroli tej technologii nasilają się. Moment ten wywołał pytania o motywy działania Google, choć firma twierdzi, że prace nad tymi zmianami trwają już od dawna.

„Jesteśmy w sytuacji, w której panuje ogromna nieufność wobec wielkich firm technologicznych, a każdy krok, który zdaje się znosić kontrolę, powoduje jeszcze większą nieufność” – powiedziała Pizzo-Fry w wywiadzie dla VentureBeat. Podkreśliła, że jasne granice etyczne były kluczowe dla budowania godnych zaufania systemów AI w czasie jej pracy w Google.

Oryginalne zasady pojawiły się w 2018 r. w trakcie protestów pracowników Project Maven, kontrakt z Pentagonem, który obejmuje wykorzystanie sztucznej inteligencji do analizy nagrań z dronów. Chociaż Google ostatecznie odmówił przedłużenia tego kontraktu, nowe zmiany mogą sygnalizować otwartość na podobne partnerstwa wojskowe.

Poprawka utrzymuje niektóre elementy poprzednich ram etycznych. Dla Google, ale odchodzi od zakazywania konkretnych aplikacji na rzecz kładzenia nacisku na zarządzanie ryzykiem. To podejście jest bardziej zgodne ze standardami branżowymi, takimi jak Ramy zarządzania ryzykiem NIST AI, choć krytycy twierdzą, że oferuje mniej rygorystyczne ograniczenia dotyczące potencjalnie szkodliwych aplikacji.

„Kwestie etyczne są równie ważne, jak tworzenie dobrej sztucznej inteligencji, nawet jeśli ich dokładność nie jest taka sama” – zauważył Bezo Fry, podkreślając, w jaki sposób względy etyczne poprawiają skuteczność i dostępność produktów opartych na sztucznej inteligencji.

Od projektu Maven do transformacji polityki: ścieżka reformy etyki sztucznej inteligencji Google

Obserwatorzy branży twierdzą, że ta zmiana polityki może wpłynąć na podejście innych firm technologicznych do etyki AI. Pierwotne zasady Google ustanowiły precedens dla samoregulacji korporacyjnej w rozwoju AI, a wiele firm zwraca się do Google o wskazówki dotyczące odpowiedzialnego wdrażania AI.

Poprawka odzwierciedla szersze napięcia w branży technologicznej, między szybkimi innowacjami a ograniczeniami etycznymi. Wraz z zaostrzeniem się konkurencji w rozwoju sztucznej inteligencji, firmy stają przed presją znalezienia równowagi między odpowiedzialnym rozwojem a wymaganiami rynku.

„Martwię się, jak szybko choroba rozprzestrzeni się na świecie i czy Plus i Plus zostaną uwolnione od tych ograniczeń” – powiedział Pitso Frei, wyrażając obawy dotyczące presji konkurencyjnej, która nakazuje szybkie wprowadzanie na rynek produktów z zakresu sztucznej inteligencji bez odpowiedniej oceny potencjalnych konsekwencji.

Dylemat etyczny wielkich firm technologicznych: czy zmiana polityki Google w zakresie sztucznej inteligencji wyznaczy nowy standard w branży?

Przegląd porusza również kwestie wewnętrznych procesów decyzyjnych Google oraz tego, jak pracownicy mogą poruszać się w kwestiach etycznych bez wyraźnych zakazów. Podczas swojej pracy w Google, Bezo-Fry opracowała procesy przeglądu, które łączyły różne perspektywy w celu oceny potencjalnego wpływu zastosowań sztucznej inteligencji.

Choć Google podtrzymuje swoje zaangażowanie w odpowiedzialny rozwój sztucznej inteligencji (AI), zniesienie konkretnych zakazów stanowi znaczące odejście od dotychczasowej roli lidera w wyznaczaniu jasnych granic etycznych dla zastosowań AI. W miarę postępu w dziedzinie AI, branża uważnie monitoruje, jak ta zmiana może wpłynąć na szerszy kontekst rozwoju i regulacji AI.

Możliwość dodawania komentarzy nie jest dostępna.