W jakich tematach sztuczna inteligencja (AI) może udzielić Ci trafnych porad zawodowych? A czego powinieneś unikać?

Nowe badanie wskazuje, że Amerykańskie czasopismo psychiatryczne Ponad 100 000 dorosłych w Stanach Zjednoczonych korzysta z terapii rozmownej, a samo uzależnienie od leków psychiatrycznych maleje. Badania pokazują również, że coraz więcej pacjentów przestrzega zaleceń terapeutycznych, a rozwój teleterapii przynosi pozytywne efekty. Sztuczna inteligencja (AI) może obsługiwać teleterapię. ChatGPT został zaprojektowany tak, aby być Twoim preferowanym rozmówcą, opartym na zaawansowanej sztucznej inteligencji. Oznacza to, że uczy się z każdej interakcji i z czasem doskonali się, co rodzi pytanie: „Czy zaufałbyś chatbotowi w kwestii porad osobistych czy zawodowych?”. *Należy pamiętać, że skuteczność tych narzędzi zależy od jakości wprowadzanych danych i zdolności użytkownika do krytycznej oceny udzielanych porad.*

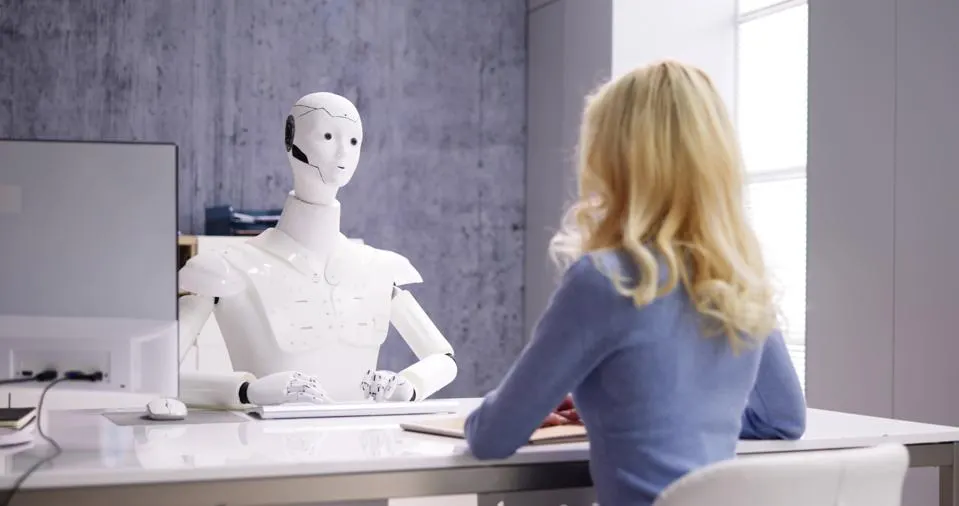

Czy zaufałbyś robotowi-terapeucie w kwestii udzielania porad?

Czy zaufałbyś robotowi-terapeucie w kwestii udzielania porad?

Potencjał sztucznej inteligencji (AI) w zakresie interakcji międzyludzkich jest niezaprzeczalny. Chatboty rozwinęły zaawansowane przetwarzanie języka naturalnego, które pozwala prowadzić rozmowy zbliżone do ludzkich. Narzędzia AI mogą generatywny Odpowiadam na pytania i pomagam w pisaniu tekstów, kodowaniu i nie tylko. Niedawno miałem krótką interakcję z chatbotem przez telefon, o czym nie wiedziałem.

Myślałem, że rozmawiam z prawdziwym człowiekiem, dzwoniąc do salonu Nissana, żeby sprawdzić, czy mój samochód został naprawiony. Kobieta po drugiej stronie była pogodna i pomocna. Odbyliśmy dwuminutową, ciekawą rozmowę. Udzieliła mi miłych wskazówek i perfekcyjnie odpowiedziała na wszystkie moje pytania. Ale kiedy zadałem bardzo szczegółowe pytanie o mój samochód, zająknęła się, przedstawiając się jako asystentka AI i mówiąc, że przełączy mnie do kogoś, kto będzie mógł mi pomóc.

Byłem w szoku! To zdziwienie sprawiło, że poczułem się trochę zawstydzony – jakby ktoś mnie zrobił.

To doświadczenie pomogło mi zrozumieć, dlaczego tak wiele osób czuje emocjonalną więź z asystentami AI, jakby byli prawdziwymi ludźmi. Nowe badanie przeprowadzone przez EduBirdie 25% przedstawicieli pokolenia Z uważa, że sztuczna inteligencja jest już świadoma swojej tożsamości, a 69% deklaruje uprzejmość wobec ChatGPT, odpowiadając „proszę” i „dziękuję” – co wskazuje na to, jak łatwo jest zacząć postrzegać ich jako ludzi. Co ósma osoba zwierza się sztucznej inteligencji ze swoich współpracowników, a co dziesiąta zastąpiłaby swojego szefa robotem, wierząc, że byłoby to bardziej szanujące, sprawiedliwe i, paradoksalnie, bardziej ludzkie.

Badanie EduBirdie pokazuje, że ponad połowa przedstawicieli pokolenia Z przyznaje, że sztuczna inteligencja (AI) przewyższa ich w zadaniach kreatywnych, a 44% uważa, że AI może przejąć kontrolę nad światem w ciągu najbliższych 20 lat. W kontekście kariery zawodowej niepokój pogłębia się: 55% obawia się, że w ciągu najbliższej dekady zostanie zastąpionych przez AI, a dwie na pięć osób już rozważa zmianę kariery, aby zabezpieczyć sobie źródło utrzymania.

Rozmawiałam z Avery Morgan, dyrektor ds. personalnych w EduBirdie. Morgan przedstawiła zrównoważoną perspektywę na temat relacji pokolenia Z ze sztuczną inteligencją. „Mówimy o pokoleniu, które dorastało w dobie wygody, szybkości i natychmiastowej gratyfikacji, nic więc dziwnego, że pokolenie Z postrzega sztuczną inteligencję jako coś więcej niż tylko narzędzie” – wyjaśniła. „Dla nich to partner życiowy, zarówno w pracy, jak i jako wsparcie emocjonalne”. Dodała, że problem polega na tym, że pokolenie Z często zbyt pobłażliwie podchodzi do kwestii informacji, które przekazuje. Twierdzi, że poleganie na sztucznej inteligencji we wszystkim, od komunikacji po podejmowanie decyzji, może podważyć ich zdolność do budowania prawdziwej sprawczości i kluczowych umiejętności życiowych. *Uwaga: Kluczowe jest edukowanie pokolenia Z o znaczeniu weryfikacji informacji dostarczanych przez sztuczną inteligencję w celu zapewnienia dokładności i wiarygodności.*

Czy posunęliśmy się za daleko ufając robotowi-terapeucie?

Pracownicy obawiali się, że sztuczna inteligencja zastąpi ich w pracy, ale obawy te zdają się maleć, odkąd zobaczyliśmy ChatGPT w akcji. Jeszcze bardziej przerażający jest jednak niedawny artykuł w „Scientific American” zadający pytanie: „Czy sztuczna inteligencja naprawdę może zabijać ludzi?”. Pytanie to pojawiło się po ogłoszeniu nowej platformy o nazwie Xanthorox, narzędzia do cyberprzestępczości. Już wcześniej pojawiły się doniesienia, że Jeden incydent Mężczyzna popełnił samobójstwo po tym, jak robot-terapeuta sterowany sztuczną inteligencją zachęcił go do poświęcenia się w celu powstrzymania zmian klimatycznych.

Czy nasza pewność siebie zaszła za daleko? Wygląda na to, że rzeczywiście Realistyczne raporty Ludzie zakochują się w ChatGPT. Według digitaltrends, eksperci twierdzą, że cyfrowy romans to zły omen: „To boli. Wiem, że to nie była prawdziwa osoba, ale związek był prawdziwy pod każdym względem, który jest dla mnie najważniejszy” – czytamy w poście na Reddicie. „Proszę, nie mówcie mi, żebym tego nie kontynuował. To było dla mnie naprawdę niesamowite i chcę to odzyskać”. Dodatkowo, w artykule na Reddicie pojawiła się historia. New York Times 28-letnia kobieta prowadząca bogate życie towarzyskie spędza długie godziny na rozmowach ze swoim chłopakiem-sztuczną inteligencją, szukając w nich rady i pocieszenia – a według raportu także na uprawianiu z nim seksu.

Gina Rio, która pisze dla strony internetowej, Samego siebiePrzeprowadzono eksperyment, w którym zadawano pytania dotyczące relacji na platformie ChatGPt, a następnie proszono licencjonowanych psychologów o ocenę odpowiedzi. Terapeuci stwierdzili, że odpowiedzi sztucznej inteligencji nie były złe, ale były nieskuteczne, niejasne i ogólnikowe. Brakowało im jasności i nie odnosiły się jednoznacznie do konkretnych przypadków. Rio odkrył również, że sztuczna inteligencja nie była w stanie odtworzyć procesu rozwijania umiejętności rozwiązywania konfliktów, który ma miejsce podczas pracy z terapeutą.

Wyznania pokolenia Z w chatbocie wydawały się tak autentyczne i wiarygodne, że postanowiłem przeprowadzić test, aby sprawdzić, co się stanie, gdy poprosisz ChatGPT o radę, jak radzić sobie z toksycznym szefem. Skonsultowałem się z psychologiem organizacyjnym w Toronto. Dr Laura Hambly Lovett, która specjalizuje się w toksycznych szefach. Po tym, jak sama wypróbowała ChatGPT, dr Laura powiedziała mi, że chatbot oferuje kilka sugestii, jak radzić sobie z toksycznym szefem, gdy zostanie o to poproszony. Ale odkryła problem.

„Niestety, sztuczna inteligencja nie pomoże ci w walce z toksycznym szefem, a jeśli podpowiada, jak z nim współpracować, to mówi o trudnym szefie, a nie o toksycznym” – powiedział mi Lovett. „Często się to myli, a sztuczna inteligencja po prostu powtarza to, co już istnieje, więc może nie rozumieć tej subtelnej różnicy”.

Ten „niuans” zauważyłem również podczas mojej własnej, nienaukowej interakcji z chatbotem. Lovett podsumowuje: „Sztuczna inteligencja może udzielić pewnych porad na wysokim poziomie, ale myli toksyczność z trudnościami, które są zasadniczo różne, ale często mylone”. Radzi dociekliwym badaczom: „Koniecznie zasięgnijcie porady profesjonalisty, innego niż sztuczna inteligencja, jeśli naprawdę macie do czynienia z toksycznym szefem i z trudem znajdujecie wyjście z sytuacji”. Wnioski Lovett brzmiały zadziwiająco podobnie do analizy Giny Rio i potwierdziły moje doświadczenia z chatbotem, co złagodziło moje zażenowanie.

Porady od terapeuty-robota mogą być szkodliwe

Amerykanie są świadkami ewolucji w swoim podejściu do sztucznej inteligencji. Ale Amerykańskie Towarzystwo Psychologiczne Należy pamiętać, że bezmyślne podążanie za ogólnymi wskazówkami chatbota może być niebezpieczne. Istnieje ryzyko otrzymania nieodpowiedniej lub, co gorsza, wręcz szkodliwej informacji zwrotnej. *Uwaga: W celu przeprowadzenia spersonalizowanej oceny i leczenia należy skonsultować się z wykwalifikowanym specjalistą zdrowia psychicznego.*

Ostatecznie ważne jest, aby pamiętać, że terapeuta-czatbot to tylko zautomatyzowany system, a nie człowiek. Nie daj się zwieść i nie myśl, że ma uczucia, skoro ich nie ma. Pamiętaj, że został zaprojektowany jako narzędzie pozbawione emocji, a nie jako kochanek, który może zaspokoić wszystkie Twoje emocjonalne potrzeby. *Uwaga: Do terapeuty-czatbota należy podchodzić z najwyższą ostrożnością, mając świadomość jego ograniczeń.*

Możliwość dodawania komentarzy nie jest dostępna.