Microsoft wprowadza Phi-4: superinferencyjny model sztucznej inteligencji, który ma konkurować z DeepSeek R1

Abstrakcyjny:

- Firma Microsoft uruchomiła modele sztucznej inteligencji Phi-4 oparte na algorytmach wnioskowania, wytrenowane przy użyciu 14 miliardów i 3.8 miliarda parametrów.

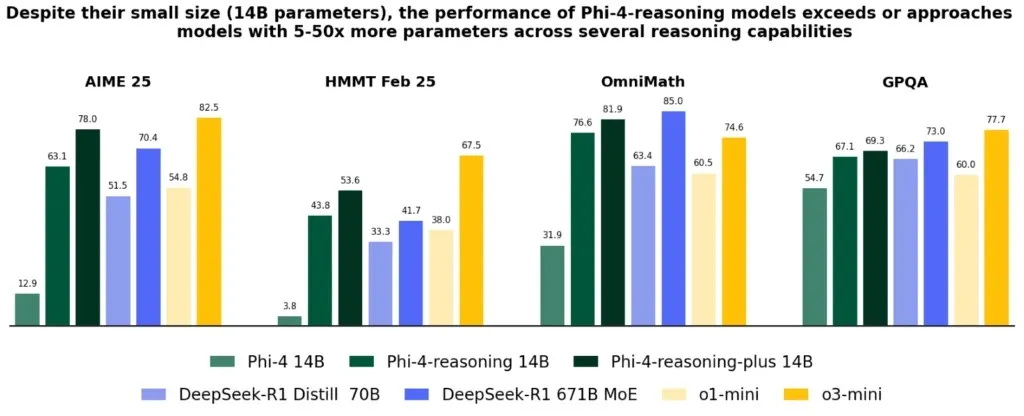

- Mimo niewielkich rozmiarów modele wnioskowania Phi-4 konkurują ze znacznie większymi modelami, takimi jak DeepSeek R1 i o3-mini.

- Firma Microsoft twierdzi, że modele wnioskowania Phi-4 można uruchomić na komputerach z systemem Windows Copilot+ ze względu na ich niewielkie rozmiary.

Firma Microsoft wprowadziła trzy nowe modele sztucznej inteligencji do wnioskowania, w tym Phi-4-reasoning, Phi-4-reasoning-plus i Phi-4-mini-reasoning. Są to niewielkie modele językowe przeznaczone dla urządzeń końcowych, takich jak komputery z systemem Windows i urządzenia mobilne. Model sztucznej inteligencji Phi-4-reasoning został wytrenowany z wykorzystaniem 14 miliardów parametrów i może wykonywać złożone zadania wnioskowania.

Model Phi-4-reasoning-plus wykorzystuje ten sam model podstawowy, ale wykorzystuje dodatkowe obliczenia czasu wnioskowania, około 1.5-krotnie większą liczbę tokenów w porównaniu z Phi-4-reasoning, aby zapewnić wyższą dokładność. Pomimo niewielkich rozmiarów modeli Phi-4-reasoning, są one konkurencyjne w porównaniu z większymi modelami, takimi jak: Głębokie wyszukiwanie R1 671B i o3-mini.

W standardzie GPQA model Phi-4-reasoning-plus-14B osiąga wynik 69.3%, podczas gdy o3-mini 77.7%. Z kolei w teście AIME 2025 Phi-4-reasoning-plus-14B uzyskał 78%, a o3-mini 82.5%. To pokazuje, że model Microsoftu mini jest bardzo zbliżony do głównych modeli rozumowania, które są znacznie większe.

Microsoft twierdzi, że modele wnioskowania Phi-4 zostały wytrenowane za pomocą nadzorowanego dostrajania.Na podstawie starannie dobranych demonstracji wnioskowania z OpenAI o3-mini„Co więcej” – pisze Microsoft – „Model ten pokazuje, że dzięki dokładnemu formatowaniu danych i wysokiej jakości syntetycznym zestawom danych mniejsze modele mogą konkurować z większymi.".

Co więcej, mniejszy model Phi-4-mini-reasoning, trenowany z wykorzystaniem zaledwie 3.8 miliarda parametrów, przewyższa wiele modeli 7B i 8B. W testach porównawczych, takich jak AIME 24, MATH 500 i GPQA Diamond, model Phi-4-mini-reasoning-3.8B zapewnia konkurencyjne wyniki, zbliżone do modelu O1-mini.DostosowaćModel Phi-4-miniDokładne wykorzystanie danych syntetycznych wygenerowanych przez model Deepseek-R1".

Modele Phi firmy Microsoft są już natywnie używane na komputerach z systemem Windows. Komputery Copilot+Wykorzystuje wbudowaną jednostkę przetwarzania neuronowego. Ciekawe będzie, jak modele wnioskowania Phi-4 poprawią wydajność sztucznej inteligencji na urządzeniu.

Możliwość dodawania komentarzy nie jest dostępna.