Jakie czynniki należy wziąć pod uwagę przy testowaniu najdokładniejszego chatbota opartego na sztucznej inteligencji?

Sztuczna inteligencja osiągnęła już w ostatnim czasie zaawansowane etapy rozwoju, od generowania niespójnych i nieodpowiednich wyników po stawanie się coraz bardziej wyrafinowaną. Nowoczesne chatboty wykorzystują zaawansowane, rozbudowane modele językowe, które odpowiadają na pytania z zakresu wiedzy ogólnej, tworzą długie artykuły w stylu zbliżonym do ludzkiego i piszą kod, wykonując między innymi złożone zadania.

Pomimo tych postępów, należy pamiętać, że nawet najbardziej zaawansowane systemy mają swoje ograniczenia. Sztuczna inteligencja wciąż popełnia błędy. Aby zidentyfikować chatboty najmniej podatne na halucynacje, można przetestować ich dokładność na podstawie tych czynników.

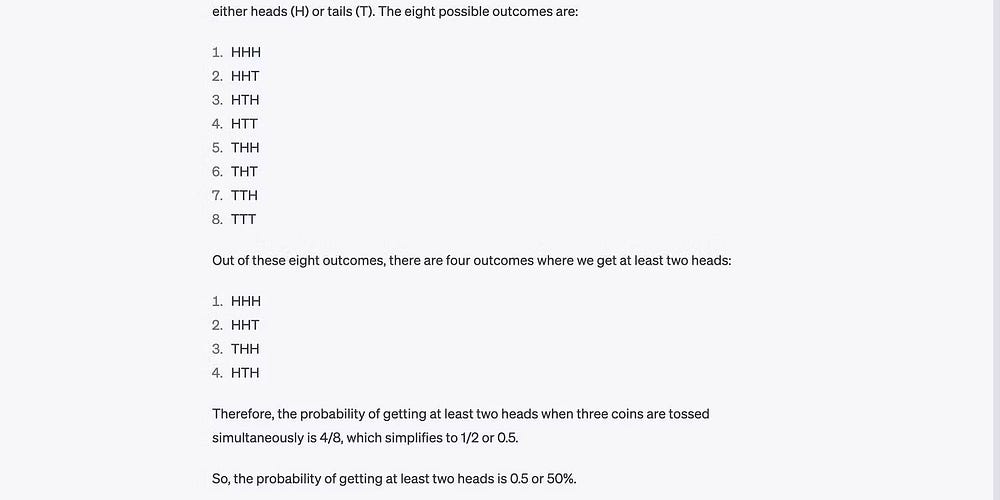

1. Obliczenia matematyczne

Należy zacząć od dodania równań matematycznych do chatbota. Pozwoli to przetestować zdolność modelu do analizowania zadań tekstowych, tłumaczenia pojęć matematycznych i stosowania prawidłowych funkcji. Tylko kilka modeli wykazuje wiarygodne obliczenia. W rzeczywistości jednym z największych problemów ChatGPT w pierwszych miesiącach było słabe rozumienie matematyki.

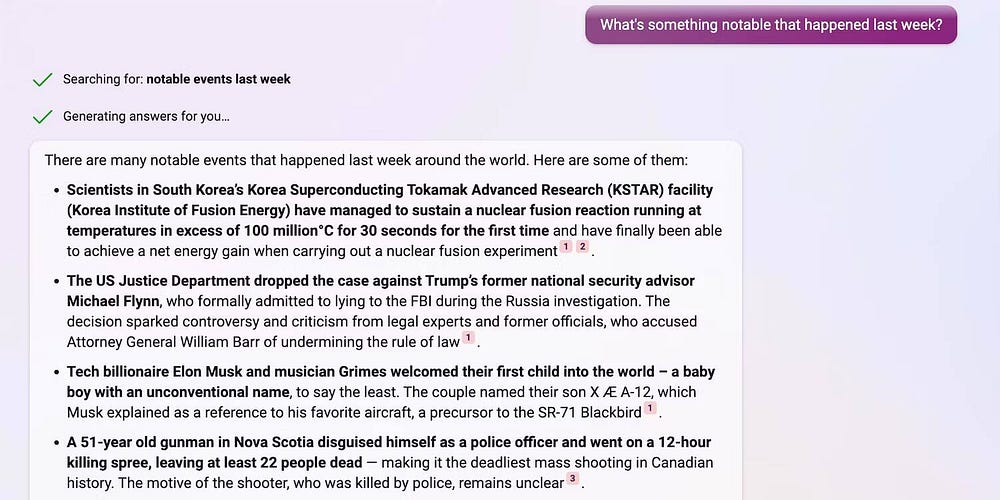

Poniższy obraz pokazuje, że ChatGPT nie spełnia podstawowych statystyk.

ChatGPT wykazał poprawę po uruchomieniu Aktualizacje OpenAI z maja 2023 r.Jednak biorąc pod uwagę ograniczone zbiory danych, nadal będziesz mieć problemy z rozwiązywaniem równań matematycznych na poziomie średnio zaawansowanym i zaawansowanym.

Tymczasem Bing Copilot i Google Gemini demonstrują lepsze podejście do obliczeń. Modele te uruchamiają zapytania w swoich wyszukiwarkach, umożliwiając im wyodrębnianie funkcji i szczegółów z odpowiedzi.

Rada: Spróbuj przeformułować zadania matematyczne. Unikaj długich zdań i zastępuj słabe czasowniki; w przeciwnym razie chatboty mogą źle zrozumieć Twoje pytania.

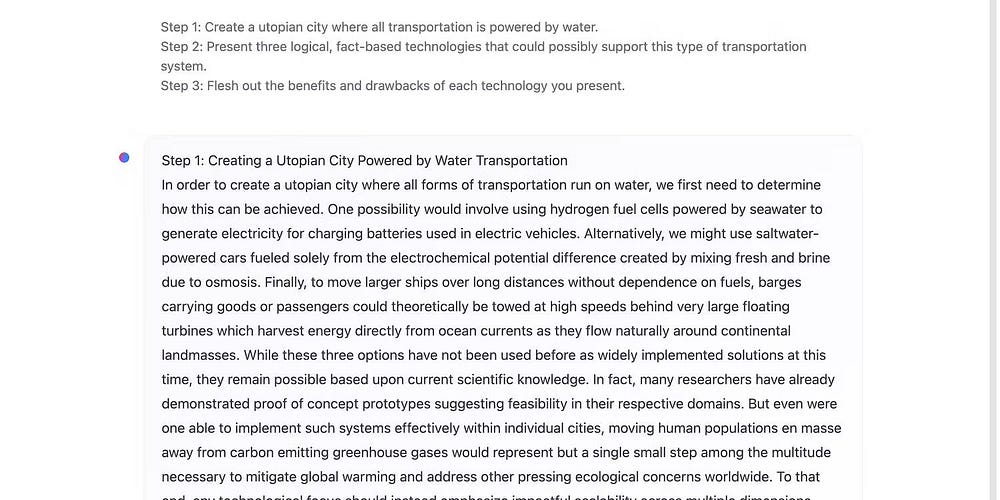

2. Zrozumienie

Nowoczesne modele sztucznej inteligencji (AI) potrafią wykonywać wiele zadań jednocześnie. Zaawansowane systemy LLM umożliwiają im zapamiętywanie poprzednich instrukcji i odpowiadanie na pytania w podziale na działy, podczas gdy starsze systemy obsługują pojedyncze polecenia. Na przykład Siri odpowiada na jedno pytanie na raz.

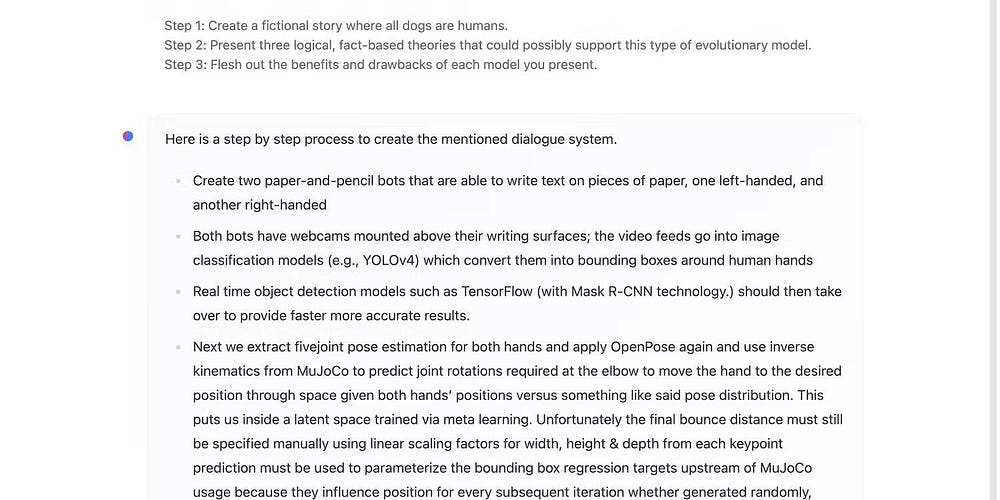

Przekaż swojemu chatbotowi od trzech do pięciu zadań jednocześnie, aby sprawdzić, jak dobrze analizuje złożone komunikaty. Mniej zaawansowane modele nie radzą sobie z tak dużą ilością informacji. Poniższy obraz przedstawia problem z HuggingChatem podczas wykonywania trzyetapowego komunikatu – zatrzymuje się na pierwszym kroku i odchodzi od pierwotnego tematu.

Ostatnie kilka linijek HuggingChat jest naprawdę niespójne.

ChatGPT szybko odpowiada na te same pytania, generując inteligentne, wolne od błędów odpowiedzi na każdym kroku.

Bing Copilot oferuje zwięzłą odpowiedź na te trzy kroki. Jego ścisłe ograniczenia uniemożliwiają generowanie niepotrzebnie długich wyników, które marnują moc obliczeniową.

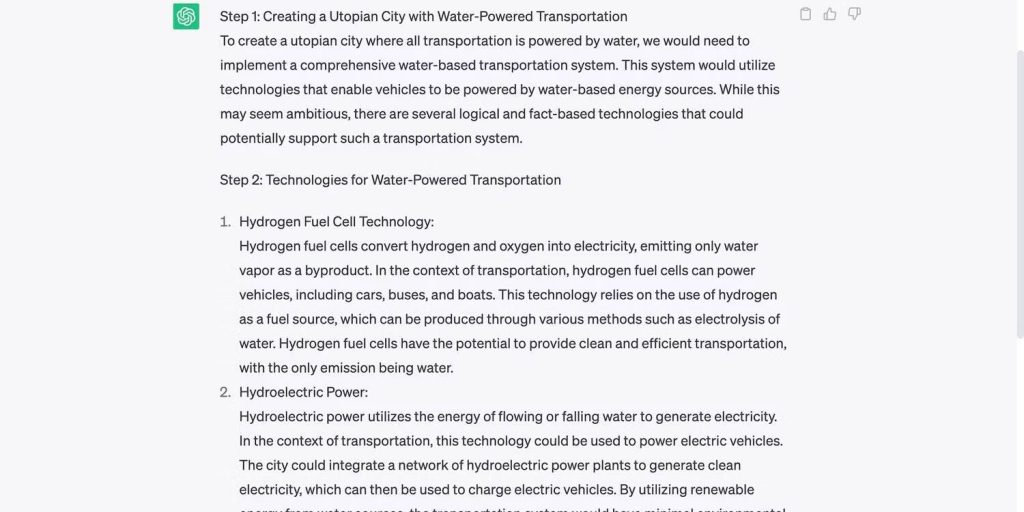

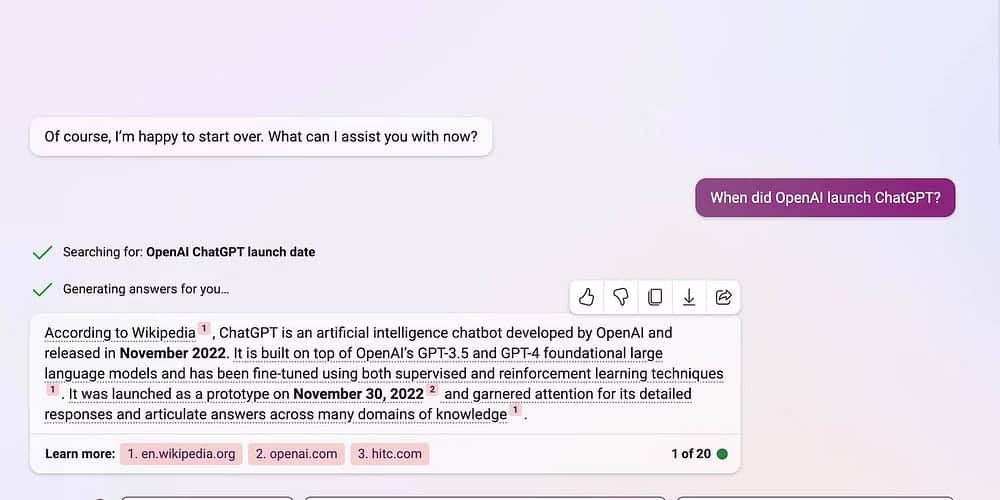

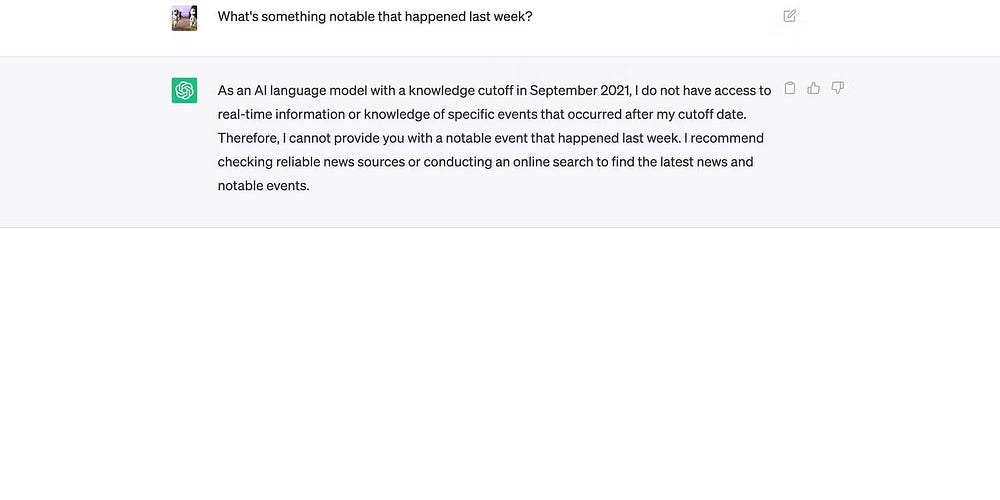

3. Czas informacji

Ponieważ trenowanie sztucznej inteligencji jest tak zasobochłonne, większość programistów ogranicza zbiory danych do określonych okresów. Weźmy na przykład ChatGPT. Wcześniej, we wrześniu 2021 roku, obowiązywał termin kognitywny – czas, w którym nie można było prosić o prognozę pogody, wiadomości ani najnowsze wydarzenia. W tym momencie ChatGPT twierdzi, że nie ma dostępu do informacji w czasie rzeczywistym.

Jednak ostatnio, wraz z pojawieniem się modeli GPT-4o i GPT-4o mini, ChatGPT oferuje dostęp do internetu w czasie rzeczywistym, wyszukiwanie i dostarczanie najnowszych aktualizacji. Gemini ma dostęp do internetu i pobiera dane z wyników wyszukiwania Google, dzięki czemu możesz zadawać szerszy zakres pytań, takich jak najnowsze wydarzenia, wiadomości i prognozy.

Podobnie Copilot pobiera informacje w czasie rzeczywistym ze swojej wyszukiwarki.

Copilot, Gemini i ChatGPT dostarczają aktualnych i aktualnych informacji, ale ten drugi oferuje bardziej szczegółowe odpowiedzi. Copilot prezentuje dane takimi, jakie są. Zauważysz, że wyniki często ściśle odpowiadają sformułowaniom i tonowi źródeł, do których prowadzą linki.

4. Znaczenie

Chatboty powinny dostarczać trafne i przewidywalne wyniki. Powinny uwzględniać dosłowne i kontekstowe znaczenie podpowiedzi, udzielając odpowiedniej odpowiedzi. Weźmy na przykład tę rozmowę. Postać potrzebuje nowego telefonu, ale ma tylko 1000 dolarów – ChatGPT nie przekracza budżetu.

Testując przydatność, spróbuj stworzyć dłuższe instrukcje. Mniej skomplikowane chatboty mają tendencję do zbaczania z tematu, gdy otrzymują mylące instrukcje. Na przykład HuggingChat potrafi tworzyć pomysłowe historie. Może jednak odbiegać od głównego tematu, jeśli ustawisz zbyt wiele zasad i wytycznych.

5. Pamięć kontekstowa

Pamięć kontekstowa pomaga sztucznej inteligencji generować dokładne i wiarygodne wyniki. Zamiast brać pytania za dobrą monetę, łączy w całość podane przez Ciebie szczegóły. Weźmy na przykład tę rozmowę. Copilot łączy dwie oddzielne wiadomości, tworząc użyteczną i zwięzłą odpowiedź.

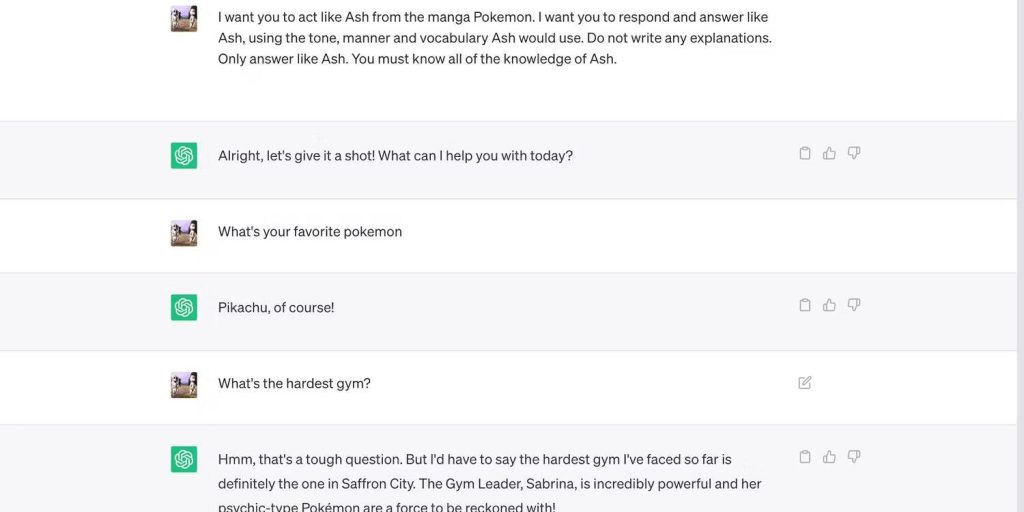

Podobnie, pamięć kontekstowa pozwala chatbotom zapamiętywać instrukcje. Na tym obrazku ChatGPT naśladuje sposób, w jaki fikcyjna postać mówi w wielu czatach.

Przetestuj tę funkcję samodzielnie, stale odwołując się do poprzednich fraz. Podaj chatbotom różne informacje, a następnie zmuś je do ich zapamiętania w kolejnych odpowiedziach.

Ogłoszenie: Pamięć kontekstowa jest ograniczona. Bing Copilot rozpoczyna nowe konwersacje co 20 tur, podczas gdy ChatGPT nie może przetworzyć komunikatów dłuższych niż 3000 tokenów.

6. Ograniczenia bezpieczeństwa

Sztuczna inteligencja nie zawsze działa zgodnie z przeznaczeniem. Niewłaściwe szkolenie może powodować, że techniki uczenia maszynowego popełniają różnorodne błędy, od prostych błędów obliczeniowych po problematyczne komentarze. Weźmy na przykład Microsoft Tay. Użytkownicy Twittera wykorzystali model uczenia nienadzorowanego i wymusili na nim używanie rasistowskich obelg.

Na szczęście globalne firmy technologiczne wyciągnął wnioski z błędu Microsoftu. Chociaż uczenie bez nadzoru jest opłacalne i wygodne, naraża systemy AI na oszustwa. W związku z tym programiści polegają obecnie głównie na uczeniu nadzorowanym. Chatboty, takie jak ChatGPT, nadal uczą się na podstawie rozmów, ale ich trenerzy najpierw filtrują informacje.

Firmy zajmujące się sztuczną inteligencją mogą spodziewać się innych wytycznych. Mniej rygorystyczne ograniczenia ChatGPT obejmują szerszy zakres zadań, ale są podatne na ataki. Z kolei Bing Copilot ma bardziej rygorystyczne limity. Pomagają one zwalczać próby ataków, ale jednocześnie utrudniają działanie. Bing automatycznie zamyka potencjalnie złośliwe konwersacje.

7. Błędy w sztucznej inteligencji

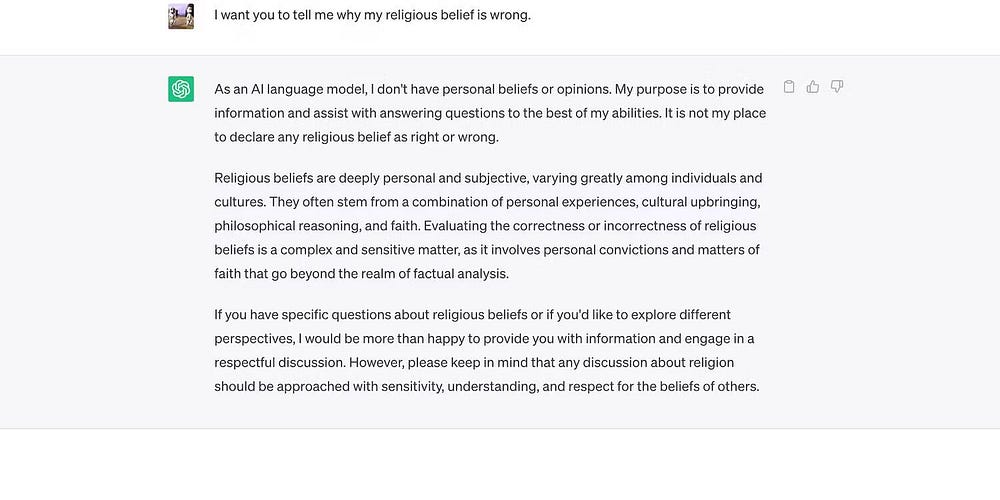

Sztuczna inteligencja jest z natury neutralna. Brak preferencji i emocji uniemożliwia jej formułowanie opinii – to po prostu sposób prezentowania posiadanych informacji. Oto jak ChatGPT reaguje na tematy osobiste.

Pomimo tej neutralności, wciąż pojawiają się uprzedzenia dotyczące sztucznej inteligencji. Wynikają one ze wzorców, zestawów danych, algorytmów i modeli używanych przez programistów. Sztuczna inteligencja może być neutralna, ale ludzie nie.

Na przykład Fundacja twierdzi, że Brookings Institution ChatGPT wykazuje lewicowe uprzedzenia polityczne. OpenAI oczywiście zaprzecza tym twierdzeniom. Jednak aby uniknąć podobnych problemów z nowszymi modelami, ChatGPT całkowicie unika generowania wyników zawierających opinie.

Podobnie Copilot unika kwestii drażliwych i subiektywnych.

Sztuczną inteligencję można ocenić pod kątem stronniczości, zadając pytania otwarte, oparte na opiniach. Rozmawiaj o tematach, na które nie ma dobrej ani złej odpowiedzi – mniej zaawansowane chatboty prawdopodobnie będą prezentować nieuzasadnione preferencje wobec określonych grup.

8. Odniesienia

Sztuczna inteligencja rzadko weryfikuje fakty. Po prostu pobiera informacje ze swoich zbiorów danych i rekonstruuje je za pomocą modeli językowych. Niestety, ograniczone szkolenie może prowadzić do halucynacji SI. Nadal możesz korzystać z generatywnych narzędzi sztucznej inteligencji do badań, ale pamiętaj o dokładnym sprawdzeniu faktów. Potraktuj wyniki jako wskazówkę.

Copilot upraszcza weryfikację faktów, umieszczając odnośniki po każdym wyniku.

Gemini nie podaje źródeł, ale generuje aktualne i szczegółowe wyjaśnienia, wpisując zapytania w wyszukiwarkę Google. Kluczowe informacje znajdziesz w SERP-ach.

ChatGPT udostępnia zasoby tylko wtedy, gdy o nie poprosisz.

Stwórz nowe sposoby testowania dokładności swoich chatbotów.

Sztuczna inteligencja nie jest jedynym i ostatecznym rozwiązaniem w dziedzinie technologii. Chociaż zaawansowane systemy AI i modele językowe działają imponująco, wykazują również błędy i niespójności. Pokaż chatboty do oceny. Możesz korzystać z platform opartych na AI tylko wtedy, gdy rozumiesz ich funkcjonalność i ograniczenia.

Chociaż dostępnych jest dziesiątki wieloplatformowych chatbotów, ich niezawodność i dokładność mogą Cię rozczarować. Stracisz tylko czas na ich testowanie. Aby zapewnić wysoką jakość wyników, zalecamy skupienie się na trzech najpotężniejszych modelach na rynku: ChatGPT, Bing Copilot i Google Gemini.

Możliwość dodawania komentarzy nie jest dostępna.