Czym jest komputerowe widzenie i jakie wyzwania niesie ono ze sobą w świecie samochodów autonomicznych?

Samochody autonomiczne to kontrowersyjny i fascynujący temat, opierający się na zaawansowanych systemach wspomagania kierowcy (ADAS) w celu osiągnięcia wysokiego poziomu bezpieczeństwa i komfortu. Chociaż w pełni autonomiczne samochody jeszcze nie istnieją, obecne technologie umożliwiają funkcje takie jak automatyczne kierowanie i autonomiczne parkowanie.

Samochody te wykorzystują zaawansowane systemy wizji komputerowej do analizy otoczenia i podejmowania inteligentnych decyzji w oparciu o różnorodne czujniki. W tym artykule omówimy podstawy wizji komputerowej i jej wpływ na efektywność zautomatyzowanej jazdy, a także wyzwania i innowacje, jakie można się spodziewać w tej dziedzinie.

Czym jest widzenie komputerowe?

Widzenie komputerowe to technologia, która pozwala maszynom widzieć i rozpoznawać obiekty w ich otoczeniu. Jest to podzbiór wizji, który koncentruje się na przemysłowych zastosowaniach detekcji obiektów wspomaganej wizją w maszynach autonomicznych, takich jak roboty i pojazdy.

Dzisiejsze systemy wizyjne wykorzystują algorytmy głębokiego uczenia SI, takie jak splotowe sieci neuronowe (CNN), do tworzenia solidnych, dobrze uogólnionych modeli, które umożliwiają precyzyjną identyfikację obiektów w różnych warunkach. Umożliwia to wdrożenie systemów wizyjnych w różnorodnych zadaniach wymagających wyższej niezawodności w przemyśle wytwórczym, rolnictwie, robotyce i motoryzacji.

Jak działa komputerowe widzenie w samochodach autonomicznych?

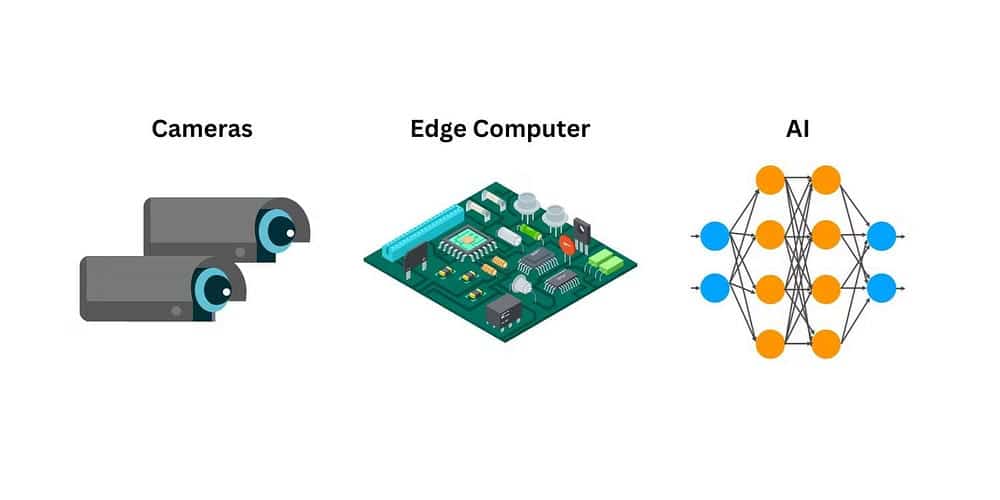

Widzenie komputerowe w samochodach autonomicznych można ogólnie podzielić na trzy części: system kamer, przetwarzanie (edge computing) oraz sztuczną inteligencję. Ten zestaw technologii pozwala autonomicznym samochodom widzieć, wnioskować i identyfikować różne znaki i przeszkody podczas jazdy. Omówmy szczegółowo każdą część, aby zrozumieć, jak te technologie łączą się, tworząc wizję maszynową samochodu autonomicznego.

System kamer

Wizja komputerowa opiera się na systemach kamer, które gromadzą wizualne informacje o otoczeniu. Samochody autonomiczne wykorzystują wiele kamer zamontowanych wokół pojazdu, aby zebrać jak najwięcej informacji wizualnych.

W kamerach wizyjnych stosowane są dwa główne sensory: komplementarny metal-tlenek-półprzewodnik (CMOS) oraz sensory CCD. W samochodach autonomicznych technologia CMOS jest często preferowana ze względu na dużą prędkość odczytu, wydajną elektronikę i możliwości przetwarzania równoległego, co czyni ją najszybszym sensorem. Rozwiązania takie jak różne tryby oświetlenia, cyfrowy noktowizor i filtry mogą pomóc sensorom CMOS w nieidealnych warunkach oświetleniowych.

W samochodach autonomicznych kamery są instalowane w określonych odległościach od siebie, aby uzyskać widzenie stereoskopowe. Widzenie stereoskopowe to zdolność łączenia dwóch lub więcej bodźców wizualnych, tworząc wrażenie głębi lub trójwymiarowości obiektów i otoczenia. To z kolei pozwala samochodom na triangulację i obliczanie przybliżonej odległości między obiektem a pojazdem.

Ponieważ ludzie mają dwoje oczu, korzystamy również z widzenia stereoskopowego. Możesz sprawdzić to samodzielnie: zamknij jedno oko i wybierz mały przedmiot leżący na biurku. Połóż dłoń na boku przedmiotu i upewnij się, że jego krawędź znajduje się co najmniej pięć centymetrów od ciebie. Zatrzymaj się na kilka sekund i sprawdź, jak pewny jesteś swojego przybliżenia. Teraz spróbuj otworzyć oboje oczu i zobacz, o ile poprawi się twoje poczucie głębi.

Edge computing

Edge computing to proces polegający na przybliżaniu możliwości przechowywania informacji i przetwarzania do urządzenia generującego te dane oraz do użytkowników, którzy z nimi wchodzą w interakcję. Tradycyjnie aplikacje przesyłały dane z urządzeń inteligentnych, takich jak czujniki i smartfony, do centralnego centrum przetwarzania danych. Jednak bezprecedensowa złożoność i objętość danych przewyższyły możliwości sieci. Systemy edge computing przybliżają możliwości przetwarzania do użytkowników i urządzeń, znacząco poprawiając wydajność aplikacji, zmniejszając zapotrzebowanie na przepustowość sieci i zapewniając szybszy wgląd w czasie rzeczywistym.

Podczas gdy system kamer w samochodzie autonomicznym gromadzi dane, komputer pokładowy (procesor brzegowy) przetwarza wszystkie dane wejściowe w czasie rzeczywistym, aby na bieżąco aktualizować system o stanie otoczenia. Chociaż typowe zadania związane z przetwarzaniem obrazu komputerowego mogą przynieść oszczędności dzięki wykorzystaniu chmury obliczeniowej, istnieje po prostu zbyt wiele zagrożeń dla samochodów autonomicznych, aby były one powiązane z chmurą, nawet jeśli wynika to z outsourcingu procesu w zakresie wymagań dotyczących widzenia maszynowego.

Wykorzystanie zaawansowanego komputera do przetwarzania danych wejściowych eliminuje problemy z opóźnieniami i zapewnia odbiór, przetwarzanie i przesyłanie danych w czasie rzeczywistym. Zaawansowane komputery do samochodów autonomicznych wykorzystują specjalistyczne jednostki, które integrują procesory graficzne AI, takie jak rdzenie Tensor Core i CUDA firmy NVIDIA.

Algorytmy sztucznej inteligencji

Algorytmy zawsze były ważnym elementem wizji maszynowej. Algorytm pozwala komputerowi rozpoznawać wszystkie wzorce, kształty i kolory dostarczane przez system kamer. Wykorzystanie sztucznej inteligencji zamiast tradycyjnych algorytmów wizji komputerowej znacznie zwiększa zdolność autonomicznego samochodu do niezawodnej identyfikacji obiektów, znaków drogowych, oznakowania poziomego i sygnalizacji świetlnej. Do szkolenia autonomicznych samochodów wykorzystuje się wiele algorytmów sztucznej inteligencji. Do najpopularniejszych należą:

- YOLO (You Only Look Once): Algorytm wykrywania obiektów w czasie rzeczywistym, który identyfikuje i śledzi obiekty w polu widzenia pojazdu.

- SIFT (Scale-Icar'sant Feature Transform): Służy do wyodrębniania cech, pomaga samochodowi rozpoznawać punkty orientacyjne i charakterystyczne obiekty w otoczeniu.

- Wykres gradientów skierowanych (HOG): Służy do rozpoznawania obiektów i koncentruje się na wyodrębnianiu lokalnych wzorców i gradientów z obrazów.

- TextonBoost: Algorytm pomagający identyfikować obiekty poprzez analizę tekstur otoczenia.

- AdaBoost: AdaBoost służy do klasyfikacji danych i łączy wiele słabych klasyfikatorów, aby podejmować trafne decyzje dotyczące obiektów i przeszkód na drodze samochodu.

Znaczenie widzenia komputerowego w samochodach autonomicznych

Wizja komputerowa to podstawowy sposób, w jaki samochód autonomiczny rozpoznaje i rozumie otoczenie. Bez wizji maszynowej samochody autonomiczne prawdopodobnie zostaną zdegradowane do poziomu 1 w skali autonomii i mogą nigdy nie osiągnąć pełnej autonomii.

Dzięki systemom wizyjnym samochody autonomiczne potrafią teraz klasyfikować obiekty, wykrywać pasy ruchu i sygnalizację, identyfikować znaki drogowe i rozpoznawać ruch uliczny.

Chociaż wiele samochodów autonomicznych korzysta obecnie z różnych czujników, takich jak LIDAR, RADAR i SONAR, wszystkie one w dużym stopniu opierają się na wizji komputerowej, aby obserwować otoczenie, identyfikować obiekty i rozumieć znaczenie znaków drogowych i sygnalizacji świetlnej. Wszystkie te dodatkowe czujniki służą wyłącznie ulepszeniu wizji maszynowej i zwiększeniu bezpieczeństwa ludzi, zwierząt i mienia.

Jednak system widzenia maszynowego może działać niezależnie, bez pomocy innych czujników, zapewniając zautomatyzowane sterowanie. W rzeczywistości najnowsze samochody autonomiczne Tesli zrezygnowały z systemu radarowego i obecnie opierają się wyłącznie na systemie widzenia maszynowego w systemie Autopilot.

Choć niekoniecznie podważa to przydatność innych technologii wykrywania, to jednak pokazuje znaczenie i potencjał komputerowego widzenia w samochodach autonomicznych.

często zadawane pytania

P1. Czym jest technologia widzenia komputerowego? W samochodach autonomicznych?

Technologia przetwarzania obrazu komputerowego to oparty na sprzęcie i oprogramowaniu system służący do analizy i interpretacji obrazów i filmów, który umożliwia autonomicznym samochodom rozpoznawanie otoczenia i podejmowanie decyzji podczas jazdy.

P2. Jak działa technologia widzenia komputerowego? W samochodach?

Pojazd jest wyposażony w liczne kamery i czujniki, które rejestrują obrazy i nagrania wideo otoczenia. Dane te są przetwarzane za pomocą zaawansowanego oprogramowania w celu analizy obrazów i rozpoznawania różnych obiektów i punktów orientacyjnych na drodze.

P3. Jakie znaczenie ma technologia komputerowego widzenia? W pojazdach autonomicznych?

Technologia wizji komputerowej jest niezbędna do autonomicznej jazdy, umożliwiając rozpoznawanie znaków drogowych, innych pojazdów i przeszkód na drodze. Te informacje w czasie rzeczywistym stanowią podstawę zautomatyzowanego podejmowania decyzji, w tym kierowania pojazdem i unikania wypadków.

P4. Jakie wyzwania stoją przed technologią widzenia maszynowego?

Technologia przetwarzania obrazu musi stawiać czoła wyzwaniom, takim jak niekorzystne warunki pogodowe (mgła i deszcz), trudności z rozpoznawaniem obiektów w całkowitej ciemności, a także ochrona danych i prywatności.

P5. Jakich przyszłych zmian można się spodziewać w tej dziedzinie?

Oczekuje się, że technologia wizji komputerowej będzie się nadal rozwijać, wraz z coraz lepszymi zastosowaniami sztucznej inteligencji oraz udoskonalonymi możliwościami wykrywania i rozpoznawania obrazu. Możliwe jest również rozszerzenie zastosowania tej technologii na obszary wykraczające poza motoryzację.

Przyszłość wizji maszynowej w samochodach autonomicznych

Wizja komputerowa stanowi fundament samochodów autonomicznych. Dzięki niej samochody widzą i postrzegają otoczenie tak samo jak ludzie. Choć wyzwania wciąż istnieją, korzyści płynące z wizji komputerowej w zakresie bezpieczeństwa i nawigacji są nie do przecenienia. Jeśli chodzi o przyszłość pojazdów autonomicznych, dalszy postęp w dziedzinie sztucznej inteligencji, przetwarzania brzegowego i/lub technologii kamer sprawi, że samochody autonomiczne staną się bardziej wydajne, co prawdopodobnie przeniesie je na wyższy poziom automatyzacji.

Możliwość dodawania komentarzy nie jest dostępna.